Почти каждый тату-мастер задаёт один и тот же вопрос: «Как вы представляете себя с этой татуировкой через сорок лет?» На первый взгляд это звучит как разумная предосторожность — попытка уберечь клиента от импульсивного решения. Но если присмотреться внимательнее, этот вопрос раскрывает нечто важное о самой природе татуировки.

Вопрос предполагает три допущения, и все три — обманчивы.

Первое: что человек знает, кто он сейчас. Что у него есть чёткое «я», способное судить о том, что ему подходит. Но в действительности клиент приходит в салон именно потому, что не знает себя. Он ищет не украшение для готовой личности, а саму эту личность.

Второе: что личность сохраняется неизменной во времени. Что человек в кресле и человек через сорок лет — один и тот же, только постаревший. Но что если никакого неизменного «я» не существует? Что если мы постоянно меняемся, и сегодняшний выбор завтра покажется чужим?

Третье: что татуировка — это эстетический выбор, вроде цвета обоев или фасона одежды. Но татуировка — это не украшение. Это попытка ответить на вопрос: «Кто я?» Это не про красоту — это про существование.

Вот парадокс: вопрос о будущем задают тому, кто пришёл потому, что настоящее невыносимо своей неопределённостью. Человек не планирует себя через сорок лет — он отчаянно пытается понять, кто он сейчас.

Тату-салон — не магазин и не клиника. Это место, куда приходят за тем, что нельзя купить: за ощущением реальности, за точкой опоры в мире, где все опоры оказались иллюзорными. Татуировка обещает то, чего не могут дать ни психотерапевт, ни священник: необратимое доказательство того, что ты существуешь.

Правильный вопрос звучал бы иначе: «От какого незнания о себе вы надеетесь избавиться с помощью этого знака?» Но такой вопрос невозможен — он разрушил бы саму экономику желания, на которой держится индустрия.

Эта статья — попытка задать этот немой вопрос вслух и понять, почему татуировка не может выполнить своё обещание.

Часть I. Тело, которое нам не принадлежит

Как власть завладела нашим телом

Прежде чем спросить, что делает татуировка, нужно понять: с каким телом она работает? Тело человека, входящего в тату-салон, — это не чистый лист. Это уже размеченная территория, на которую претендуют школа, работодатель, медицина, государство.

Мишель Фуко в книге «Надзирать и наказывать» показал, как современная власть работает с телом. Школа учит сидеть за партой определённым образом. Армия — маршировать в строю. Фабрика — выполнять одни и те же движения часами. Больница — подчиняться медицинским процедурам. Результат — «податливое тело», которое можно использовать, контролировать, оптимизировать. Наша «естественность» — результат невидимой дрессировки.

Пьер Бурдьё добавил к этому понятие «габитуса» — привычек тела, впитанных из социальной среды. Походка, осанка, жесты, манера говорить — всё это несёт печать нашего класса и воспитания. Рабочий и чиновник узнаваемы не по одежде, а по тому, как они держат своё тело. Это знание, которым тело обладает, не осознавая этого.

Посмотрим на современного офисного работника. Его тело принадлежит графику: просыпаться в семь, быть на месте к девяти, сохранять продуктивность до шести. Дресс-код диктует, как одеваться. Корпоративная культура требует определённой мимики («улыбайтесь клиентам»), определённых интонаций («будьте позитивны»). Тело работника — это тело напрокат. Он временный пользователь собственной плоти.

Ещё тотальнее медицинский контроль. Диспансеризации, «профилактические осмотры» — тело регулярно предъявляется для сертификации его «нормальности». Индекс массы тела, уровень холестерина, артериальное давление — всё должно укладываться в «норму». «Здоровый образ жизни» становится моральным долгом. Болезнь воспринимается как личная неудача, недостаток дисциплины.

Современный капитализм превращает тело в капитал. «Инвестируй в себя» означает: относись к своему телу как к активу, который нужно развивать и оптимизировать. Фитнес, диеты, биодобавки — тело становится предприятием, которым управляет сам человек. Но это принудительное управление: рынок требует «конкурентоспособного» тела, и человек принимает это требование как своё желание.

Итак, тело современного человека — уже размеченная территория. Прежде чем он успевает спросить «чьё это тело?», за него уже ответили государство, работодатель, медицина, рынок. Человек не владеет своим телом — в лучшем случае арендует его на чужих условиях.

На этом фоне татуировка возникает как попытка вернуть себе своё тело.

Текучий мир и потерянное «я»

Зигмунт Бауман назвал современность «текучей» — в ней всё твёрдое тает, всё устойчивое растворяется. Это не просто быстрые перемены. Это мир, в котором сама нестабильность стала нормой. Долгосрочные планы заменены краткосрочными контрактами. Устойчивость из добродетели превратилась в порок, а «гибкость» стала принудительным требованием.

Что это значит для человека? Невозможность строить планы. Карьера перестала быть последовательным восхождением — теперь это серия непредсказуемых скачков, каждый из которых может обернуться падением. Нет гарантированной работы, отношений, места в мире. Большинство живёт в состоянии постоянной неопределённости.

Ричард Сеннетт в книге «Коррозия характера» показывает: требование постоянной «гибкости» разрушает саму способность рассказать связную историю о себе. Характер — это умение видеть в своей жизни направление и смысл. Но как сохранить характер, когда каждые два-три года тебя заставляют «переизобретать себя»? Когда навыки, которые ты развивал годами, объявляют устаревшими? Когда верность компании награждается увольнением?

Современный человек — это человек самоэксплуатации. Если раньше власть говорила «ты должен», то теперь мы сами себе говорим «я могу, значит должен мочь больше». Мы стали одновременно заключёнными и надзирателями. Выгорание — не случайность, а закономерность.

Особенно сложна множественность ролей без центра. Человек одновременно — работник, потребитель, родитель, партнёр, гражданин, пользователь соцсетей. Каждая роль требует своей версии «себя». Но где тот, кто играет все эти роли? Есть ли лицо за масками, или только бесконечная смена масок?

Парадокс современности: нам постоянно говорят «будь собой», «найди себя», «следуй своей страсти». Индустрия саморазвития работает на полную мощность. Но все эти призывы звучат в ситуации, когда сами условия жизни делают невозможным формирование устойчивого «я». «Будь собой» — но меняйся каждые два года. «Найди свою страсть» — но помни, что рынок переменчив. «Будь верен себе» — но оставайся гибким.

Результат — онтологическая бездомность. Человек без почвы, без опоры, без того места, которое можно назвать своим. Он везде и нигде, всегда на связи и всегда одинок, окружён возможностями и парализован выбором.

Важно: кризис идентичности — не личная неудача. Это не результат неправильного воспитания или недостаточной «работы над собой». Это структурное свойство позднего капитализма. Система, требующая постоянного «переизобретения себя», производит людей, которые не могут знать, кто они. Это не ошибка системы, а её функция: текучий человек — идеальный потребитель (его желания никогда не удовлетворены окончательно) и идеальный работник (он готов адаптироваться к чему угодно).

На этом фоне татуировка появляется как попытка сопротивления. В мире, где всё текуче, она обещает нечто твёрдое. В мире, где всё отменяемо, она необратима. В мире, где человек не знает, кто он, она предлагает ответ — буквально выбитый на коже.

Часть II. Татуировка как проект спасения

Что значит выбрать необратимое в мире, где всё можно отменить? Работу можно сменить, партнёра оставить, город покинуть, взгляды пересмотреть. Но татуировку — по крайней мере теоретически — нельзя отменить. (То, что существует лазерное удаление, относится к другому акту — акту отречения, о котором мы поговорим позже.)

Философ Сёрен Кьеркегор различал два способа жить. «Эстетик» живёт в мире бесконечных возможностей — он не выбирает, потому что каждый выбор означает потерю других вариантов. «Этик», напротив, решается на выбор: он принимает конечность, соглашается на потерю, связывает себя обязательством.

Татуировка — попытка совершить такой выбор. Человек, парализованный бесконечностью опций, делает нечто безвозвратное — и в самой этой безвозвратности надеется найти освобождение. «Я больше не могу передумать» — это не ограничение, а утешение.

Мартин Хайдеггер говорил о «решимости» — способности принять своё существование, вместо того чтобы раствориться в анонимной массе «людей», которые диктуют, как «следует» жить. Татуировка читается как жест такой решимости. Человек выходит из безликой толпы и говорит: «Это моё тело. Этот знак — мой». Он пытается установить что-то собственное, неотменяемое.

Но здесь обнаруживается первый парадокс. Чтобы выбрать свой символ, нужно уже знать, кто ты. Но знание о себе — это именно то, чего нет и что татуировка должна произвести. Задача похожа на попытку вытащить себя за волосы из болота.

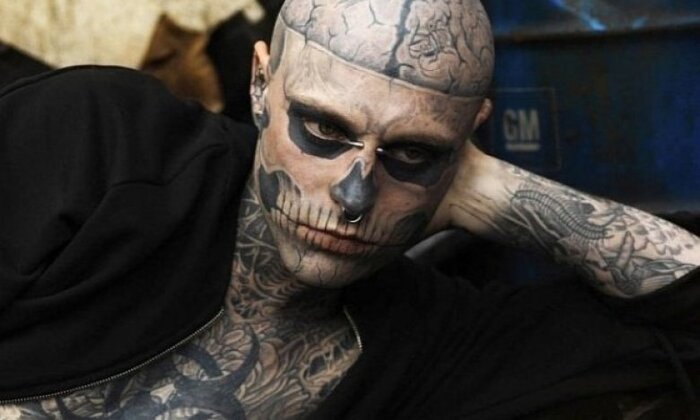

Результат — массовое обращение к готовым образам. Tribal-узоры, символ бесконечности, якоря, ласточки, цитаты на латыни. То, что переживается как радикально индивидуальный жест, оказывается повторением чужого. Pinterest и Instagram становятся источниками «уникальной» идентичности. Человек, пытаясь вырваться из толпы, воспроизводит её вкусы на уровне выбора.

Психоаналитик Жак Лакан объяснял: наше «я» формируется через образы, которые всегда приходят извне — из зеркала, от других, из культуры. Нет «подлинного» я, которое было бы отчуждено — есть только процесс формирования через чужие образы.

Татуировка — попытка закрепить образ на плоти. Если моё «я» — это образ, то татуировка обещает приклеить его к телу навсегда. Но образ, который человек выбирает, уже был чужим: из каталога, из интернета, из культурного архива. Даже в попытке индивидуации человек остаётся в плену готовых форм.

Первое противоречие: жест радикальной уникальности совершается с помощью чужих символов.

Процесс татуирования имеет структуру ритуала. Сначала — выбор изображения, когда человек смотрит на эскиз и проецирует себя будущего: «С этой татуировкой я буду...» увереннее, загадочнее, глубже? Изображение работает как обещание трансформации.

Затем — ожидание. Запись, очередь, иногда недели. Это время наполнено предвкушением: человек живёт в ожидании события. Повседневность становится временем «до» — до момента, когда всё изменится. Эта структура типична для религиозного сознания: ожидание решающего события, которое расколет время на «до» и «после».

Тату-салон — особое пространство. Антрополог Виктор Тёрнер называл такие места «лиминальными» — пороговыми. Это ни то и ни другое: ни обычный мир, ни священное пространство. Особый запах, звук машинки, специфический свет. Посетитель выпадает из повседневности. Он уже не прежний человек, но ещё не новый. Он — в переходе.

Мастер играет несколько ролей одновременно: жрец (совершает ритуал), хирург (вторгается в тело), художник (создаёт образ). Человек отдаёт себя — буквально своё тело — в руки другого. Это акт доверия, редкий для современности с её требованием постоянного контроля.

Боль — не побочный эффект, а структурный элемент.

Во-первых, боль удостоверяет реальность. В мире, где всё виртуализировано и опосредовано экранами, боль несимулируема. Больно — значит, по-настоящему.

Во-вторых, боль делает татуировку заслуженной. Человек не просто получает знак — он его выстрадывает. То, что далось легко, не имеет ценности. Боль — это плата, и именно плата придаёт результату вес.

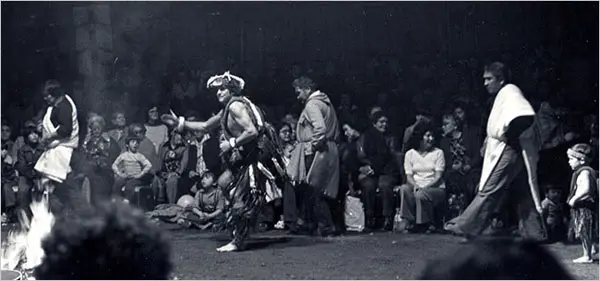

В-третьих, боль связывает с древними обрядами инициации. Антрополог Мирча Элиаде показал: обряды перехода почти всегда включают страдание. Через боль человек умирает для прежнего статуса и рождается для нового. Татуирование воспроизводит эту структуру.

В процессе нанесения тело пассивно — оно претерпевает воздействие. Человек не может контролировать происходящее; его задача — выносить. Это добровольная сдача контроля, и в мире постоянного самоуправления такая сдача переживается как облегчение. Наконец-то можно не контролировать.

Одновременно происходит воссоединение с телом. Обычно мы живём так, что тело незаметно — оно служит целям, но остаётся в тени. Боль возвращает тело в фокус. Человек не может отвлечься. Он — здесь, сейчас, в этом теле.

Момент завершения — кульминация. Человек смотрит на татуировку в надежде узнать: «Вот — я». Он видит не то, что есть, а то, чем хотел бы быть. «Теперь я другой» — типичное переживание. Человек верит, что трансформация состоялась.

Следующий шаг показателен: фотографирование и публикация в соцсетях. Татуировка должна быть увидена. Она требует взгляда другого, ищет признания. Лайки и комментарии — знаки того, что признание состоялось.

Структура татуирования повторяет древние ритуалы: отделение от прежнего (подготовка) → пороговое состояние (процесс) → включение в новое (выход с татуировкой). Но работает ли этот современный ритуал?

Часть III. Почему обещание не выполняется

Присутствие, которого нет

Татуировка обещает присутствие. Она обещает, что идентичность наконец-то будет здесь — материально, видимо, навсегда. Она обещает конец бесконечной игры смыслов, твёрдую точку. «Это я, и это не требует интерпретации».

Но философ Жак Деррида показал: такое «полное присутствие» — иллюзия. Вся западная философия верила, что смысл может быть дан целиком, что знак может совпасть с тем, что он означает. Но смысл всегда отложен, всегда опосредован. Знак отсылает к другим знакам, а не к «самой вещи». Нет первичного присутствия — есть только игра различий и отсрочек.

Татуировка — это след. Она указывает на момент нанесения, но этот момент уже прошёл. Она хранит память о выборе, но память — не воскрешение, а лишь след отсутствия. Она отсылает к человеку, который выбирал, но этот человек уже не тот, кто сейчас смотрит на татуировку.

Представьте: человек набил в двадцать лет цитату, которая тогда значила для него что-то важное. Теперь ему сорок. Что означает эта цитата сегодня? Уже не то, что значила тогда — она означает «когда-то это было важно для меня». Она отсылает не к смыслу, а к утраченному смыслу. Она — знак отсутствия того, кто мог переживать этот смысл как живой.

Татуировка не удерживает идентичность — она демонстрирует её невозможность. Она свидетельствует: «То „я", которое это выбирало, больше не существует». Каждый взгляд на татуировку — археологический жест, раскапывающий собственное прошлое, которое никогда не станет снова настоящим.

Деррида и его коллеги использовали метафору «крипты» — места в психике, где захоронено то, что не может быть ни оплакано, ни интегрировано. Татуировка работает как крипта на коже. Она хранит призрак прошлого «я» — того, кто делал выбор, кто надеялся на перерождение. Этот призрак не интегрирован в настоящее — он законсервирован. Татуировка — памятник несбывшемуся проекту.

Особенно показателен феномен «устаревших» татуировок. Tribal-узоры начала 2000-х, символы бесконечности, надписи «живи моментом» — всё это некогда казалось выражением индивидуальности, а теперь маркирует эпоху, датирует человека. Он смотрит на своё тело и видит не себя — он видит моду прошлого.

Чувства показательны: стыд, отчуждение, раздражение. Татуировка обнажает претензию — претензию на уникальность, которая оказалась массовой; претензию на вечность, которая оказалась модой. Татуировка разоблачает: человек не знал себя, когда думал, что знает.

Практика cover-up — закрытие старой татуировки новой — это попытка перезаписи. Но новый символ не более «окончательный», чем предыдущий. Он тоже станет следом, тоже устареет, тоже потребует замены. Цепочка бесконечна.

Лазерное удаление — радикальный вариант. Человек пытается стереть след, отменить выбор, вернуться к «чистому» телу. Но след не стирается бесследно: остаётся шрам, остаётся память. «Чистого» тела больше нет — можно лишь добавить слой отрицания, который тоже будет значить.

Почему ритуал не работает

Теоретик Джудит Батлер показала: идентичность — не субстанция, а процесс. Она производится через повторение действий, жестов, стилизаций. Нет сущности, которую выражают действия — есть только действия, которые создают иллюзию сущности.

Это критично для понимания татуировки. Если идентичность требует постоянного воспроизводства, то единичный акт — каким бы интенсивным он ни был — не может её установить. Татуировка — один перформатив, одно событие. Но идентичность требует ежедневной работы. Нельзя стать «собой» раз и навсегда.

Татуировка страдает структурной недостаточностью: она пытается разом решить проблему, которая по природе требует процесса.

Это объясняет серийность. Первая татуировка не сработала — не технически, а экзистенциально. Обещанная трансформация не состоялась. Человек по-прежнему не знает, кто он. Значит, нужна вторая. Вторая тоже не срабатывает — нужна третья.

Серийность — не накопление идентичности, а симптом её невозможности. Если бы одна сработала, вторая не понадобилась бы. Множественность указывает на провал каждой в отдельности.

Есть и другая проблема: отсутствие социальной поддержки. Традиционные ритуалы работают, потому что встроены в символическую систему сообщества. Обряд инициации работает, потому что все признают: прохождение через испытание означает переход в новый статус.

Татуировка — часто приватный ритуал. Её смысл не разделяется сообществом. Другие видят рисунок, но не понимают значения, которое вкладывает носитель. Социальное признание касается эстетики («красиво»), но не онтологии («ты стал другим»).

Это инициация в никуда. Ритуал без сообщества. Переход, который не ведёт к новому статусу. Человек совершает жест, полный личного смысла, но социальная реальность остаётся неизменной. На следующий день мир относится к нему так же, как вчера.

Часть IV. Татуировка как симптом

Попытка вернуть своё тело

Вернёмся к началу: тело человека ему не принадлежит. Оно принадлежит работодателю, государству, медицине, рынку. Человек — временный пользователь собственной плоти.

Татуировка — жест возвращения. Человек делает с телом то, что не санкционировано никакой инстанцией. Он наносит знак, который не нужен ни для работы, ни для здоровья, ни для документов. Это бесполезный акт — и в его бесполезности заключается ценность.

Философ Жорж Батай описывал суверенитет как выход за пределы расчёта и пользы. Суверенный акт — тот, который ничему не служит и потому свободен. Татуировка — попытка такого акта. Она не увеличивает «человеческий капитал», не улучшает показатели. Она — трата, дар самому себе.

Татуировка может читаться как утверждение: «Это тело моё, и я доказываю это тем, что делаю с ним нечто необратимое». Когда человек лишён контроля над внешним миром, он обращает агентность внутрь — на единственную территорию, которая ему доступна.

Философ Жан-Люк Нанси настаивал: тело — это не «внутри», а «снаружи». Тело — это явленность миру, поверхность. Татуировка работает с этой поверхностью. Она делает явленность намеренной: человек выбирает, что будет выставлено. В мире, где тело постоянно подвергается чужому взгляду, татуировка — попытка определить, что этот взгляд увидит.

Но есть критическое ограничение. Суверенитет татуировки — миниатюрный. Это возврат поверхности, но не условий. Человек отмечает своё тело — и идёт на ту же работу, подчиняется тому же графику. Реальное отчуждение никуда не исчезло.

Более того, сама татуировка встраивается в рыночную логику. Существует индустрия — салоны, конвенции, Instagram с миллионами подписчиков. «Индивидуальность» становится товаром, «уникальность» — трендом. Жест, переживаемый как выход из системы, оказывается её частью. Рынок абсорбирует любой протест и продаёт его обратно как «стиль жизни».

Зигмунд Фрейд описывал «навязчивое повторение»: человек воспроизводит травматические ситуации снова и снова, потому что травма не была переработана. То, что не может быть сказано, повторяется в действии.

Серийность татуировок легко читается через эту логику. Каждая новая — попытка наконец-то осуществить перерождение, которое не состоялось раньше. «На этот раз будет иначе. На этот раз сработает». Но не срабатывает — и цикл повторяется.

Это не сознательный расчёт. Человек чувствует смутное влечение, которое не может объяснить. Он хочет татуировку — и не знает точно, почему. Само это незнание симптоматично: влечение к повторению работает бессознательно.

Жак Лакан развивал идеи Фрейда: бессознательное структурировано как язык, где смыслы постоянно скользят, не закрепляясь. Нет «последнего слова», которое остановило бы эту игру.

Татуировка — означающее на коже. Но она не останавливает скольжение. Она сама требует интерпретации («что это значит?»), и каждое объяснение отсылает к другим смыслам. Человек надеется, что татуировка станет точкой стабилизации — тем знаком, который окончательно скажет, кто он. Но это невозможно: никакой знак не может выполнить эту функцию навсегда.

Лакан вводил понятие jouissance — наслаждение, несводимое к простому удовольствию и содержащее элемент страдания. Это влечение, которое нельзя удовлетворить окончательно: каждое удовлетворение оставляет осадок, требующий нового круга.

Татуирование с его болью, напряжением, интенсивностью производит такое наслаждение-страдание. Это не просто «приятно» — это сложнее и глубже. Человек ищет этого переживания, не понимая до конца, что именно он ищет. Тело становится полем для записи, которое никогда не заполнится. Сколько бы татуировок ни было — всегда остаётся место для ещё одной.

Когда человек не может направить агрессию на внешний источник отчуждения — на систему, на структуру — он обращает её внутрь. Тело становится одновременно врагом и жертвой: врагом, которого нужно наказать и контролировать; жертвой, о которой после можно позаботиться.

Это садо-мазохистская динамика, но не в клиническом смысле. Философ Жиль Делёз показал: мазохизм — это структура, в центре которой договор. Мазохист заключает контракт с собой: «Я согласен на боль в обмен на...» — на что? На интенсивность, на ощущение реальности, на контроль через сдачу контроля.

Татуировка — договор с самим собой. Человек добровольно подвергается боли, зная, что она конечна, что она под контролем, что она — часть сделки. Это боль регулируемая, в отличие от боли жизни — случайной, несправедливой, непредсказуемой. В мире, где страдание обрушивается без смысла, татуировка предлагает страдание осмысленное.

Мазохистский аспект проявляется в том, как человек относится к телу как к объекту контроля. Тело, которое «предаёт» — болеет, устаёт, стареет, не соответствует идеалам — подвергается модификации. «Я делаю себе больно, чтобы почувствовать, что существую» — эта формула применима здесь, хотя и в социально приемлемой форме.

Параллель с самоповреждением не случайна. Исследования показывают схожие паттерны: чувство потери контроля, размытость идентичности, затруднённый доступ к собственным эмоциям. Различие — в степени социальной приемлемости.

Садистский аспект — в ненависти к телу, которое кажется ответственным за страдание. Тело не соответствует желаемому образу, выдаёт возраст, класс, историю. Татуировка — наказание: «Ты будешь нести этот знак». Тело лишается голоса; решает «я», тело лишь претерпевает.

Но это «я», которое решает, — тоже конструкция, тоже продукт отчуждения. Человек раздваивается: часть отождествляется с сознанием и волей, другая сбрасывается на тело, объявляется «не-я», другим. Татуировка поддерживает это расщепление. Но это иллюзорная власть: человек атакует себя самого.

Цикл: тревога из-за неопределённости → татуировка как попытка решения → временное облегчение → возвращение тревоги → новая татуировка. Тело становится полем битвы, которую невозможно выиграть.

Важно: это не личная патология. Это структурный ответ на ситуацию, где человек лишён ресурсов для построения идентичности, лишён возможности влиять на условия существования, лишён языка для артикуляции страдания. Аутоагрессия — политически безопасный канал. Она не угрожает системе, не требует солидарности, не предполагает анализа структурных причин.

В этом глубочайшая функция татуировки как симптома: она позволяет не думать о социальном, переводя всё в регистр личного выбора. «Я набил татуировку» — не «система лишила меня идентичности». Человек берёт на себя ответственность, которую не должен нести, — и тем самым освобождает систему от вопросов.

Часть V. Письмо на смертной коже

Татуировка стареет. Это очевидность, которую легко забыть в момент нанесения, но которая раскрывает глубокую истину. Чернила расплываются, линии теряют чёткость, цвета блёкнут. Кожа — субстрат, на котором обещалось вечное — сама подлежит времени: морщится, растягивается, провисает.

Татуировка двадцатилетнего на теле шестидесятилетнего — уже не тот же рисунок. Это след, наложенный на другие следы. Татуировка на молодой коже обещала остановить время; на старой — демонстрирует, что обещание было ложным.

И всё же в этом провале есть нечто превосходящее наивную надежду.

Татуировка не победила время, но стала его свидетелем. Она не сохранила идентичность двадцатилетнего, но хранит память о том, что такая идентичность когда-то проектировалась. Она не обеспечила присутствие, но осталась следом — и след, возможно, это всё, на что мы можем рассчитывать.

Деррида учил: метафизика полного присутствия — иллюзия, но иллюзия — не ничто. След — не присутствие, но он есть. Он отсылает, различает, откладывает — но в этом откладывании что-то остаётся. Татуировка материализует это «что-то»: нетождественность себе, прерывность, несовпадение.

В конечном счёте честность татуировки — помимо её воли и против её намерения — в том, что она обнаруживает конечность. Человек хотел преодолеть время и обнаружил, что он во времени. Хотел зафиксировать себя и понял, что он не то, что можно зафиксировать. Хотел найти точку опоры и обнаружил, что опоры нет — есть только движение, только поток, только изменение.

Эта неудача — не чистое поражение. Она учит тому, чему не научат курсы по саморазвитию: человеческое существование не имеет фундамента. Оно не решается жестом, ритуалом, знаком. Оно выносится — день за днём, без гарантий, без твёрдой почвы.

Тату-мастер спрашивает: «Как вы представляете себя с этой татуировкой через сорок лет?»

Честный, хотя и невозможный для клиента ответ звучал бы так:

«Я не представляю себя через сорок лет, потому что того "себя", который мог бы это представить, ещё не существует. Я делаю эту татуировку не для будущего, а для сегодняшнего себя — того, кто отчаянно ищет опору в беспочвенности, знак в мире без знаков, присутствие там, где его не может быть.

Через сорок лет — если они будут — я стану другим, и татуировка станет другой, и вопрос о том, "та же" ли она, потеряет смысл. Останется только след — свидетель того, что однажды кто-то пытался».

Татуировка — жалкая попытка преодоления тленности. Но в своей жалкости она человечна. Она свидетельствует: человек не смирился, он искал, он — пусть ошибочно, пусть наивно — хотел быть. Он не согласился быть только функцией, только ресурсом, только телом-объектом. В нём оставалось нечто, требовавшее знака — пусть даже знак оказался неуместным, требование неутолимым, а надежда обречённой.

Мы не можем преодолеть время. Мы можем лишь поставить на нём метку. Татуировка — попытка подписаться под существованием. Попытка обречённая — но кто из нас не обречён?

Тело остынет, кожа истлеет, чернила растворятся. Но прежде — на короткий срок, называемый жизнью — они были здесь, были знаком. Не присутствием, но его тенью. Не ответом, но вопросом, выбитым в коже.

Но это всё, что у нас есть.