Учимся генерировать анимации при помощи AI Stable Diffusion

Ниже видео полноценная статья. Если она вам поможет или расскажет что интересное\полезное, прошу подписаться на канал и оформить царский просмотр с лайком <3

https://www.youtube.com/watch?v=k34PpQvqDU8

Сейчас мы научимся генерировать анимации при помощи нейросетей. Пример:

Небольшое предысловие:

Данный гайд предназначено для +- продвинутого пользователя. В нём я не затрону то как устанавливать нейросеть на ваш пк. Однако оставлю ссылочки на то как это делается. Использовать мы будем Стабильную Дефузию. Если у вас видеокарта 2000 серии и выше, то переходите по этой ссылке, там инструкция как всё поставить на ваш железо.

https://www.youtube.com/watch?v=ycQJDJ-qNI8

Если у вас ноутбук или совсем слабенький ПК, то переходите по второй ссылке, там расскажут как запустить нейросеть на Google Colab.

https://www.youtube.com/watch?v=reaj2_G38qs

Весь процесс генерации анимации будет выглядит по этапам так:

Выбор исходника\реффа видео.

Создание секвенции из видео.

Настройка нейросети.

Генерация отдельных кадров анимации.

Массовая генерация кадров секвенции.

Финальная обработка конечного результата.

И так дальше по этапам.

Первый этап (1) - За исходник сойдёт любое видео которое вы подберёте, единственное что могу посоветовать в это плане, это то что исходник должен быть чётки, и всё на нём "читаться" легко. Персонаж не должен сливаться с фонов. Чем лучше начальный исходник, тем лучше будет результат. Но это не значит что вы не можете взять совсем болванки. У этого есть свои особенности, но вполне юзабельно.

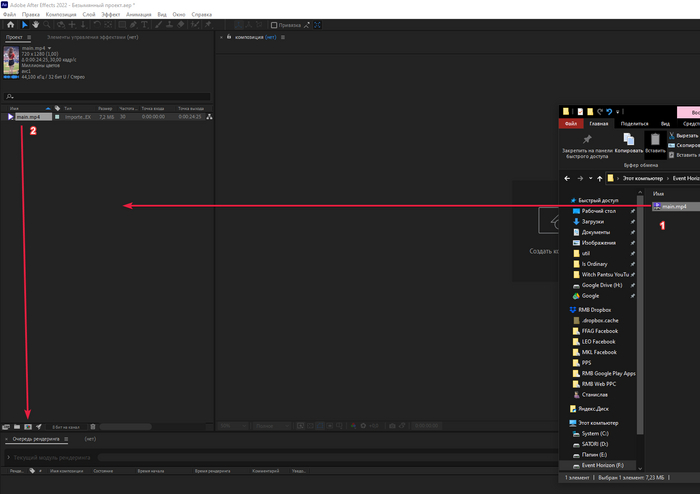

Второй этап (2) - Секвенция это покадровое разделение видео. Для создания секвенции из вашего реффа подойдёт почти любая программа для видеомонтажа. Я же использую Affter Effects. Что бы создать секвенцию в нём, загружаем видеофайл в программу.

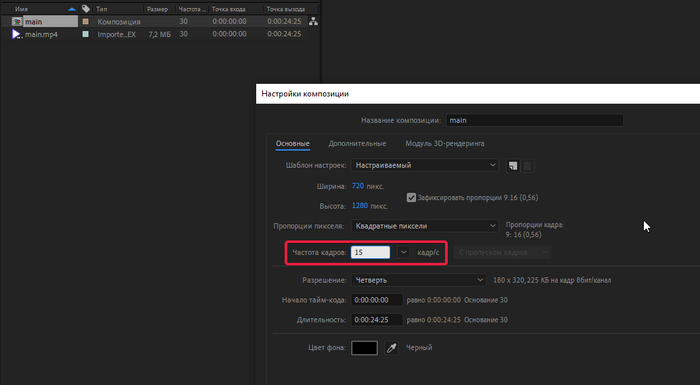

Делаем из него композицию и при необходимости обрезаем видео\редактируем. Самый лучший момент подправить ваш исходник! Далее важный момент, нужно выставить композиции 15 кадров в секунду. Так как начальные 30 либо 60 это многовато. Оно откушает много вашего времени на этапе работы с нейросетью, а так же сделать из финального результата полнейшую эпилепсию.

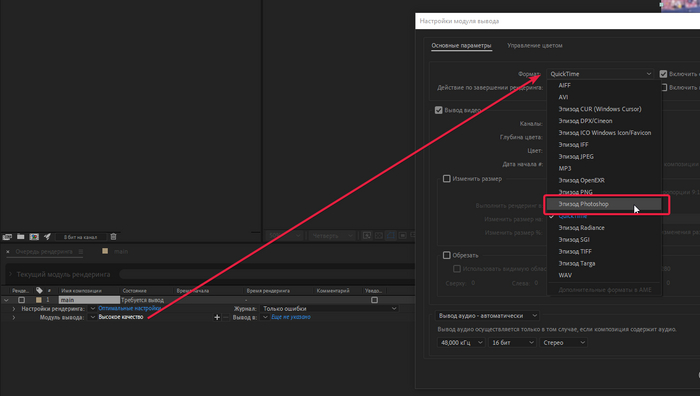

После чего рендерим как Эпизоды PNG.

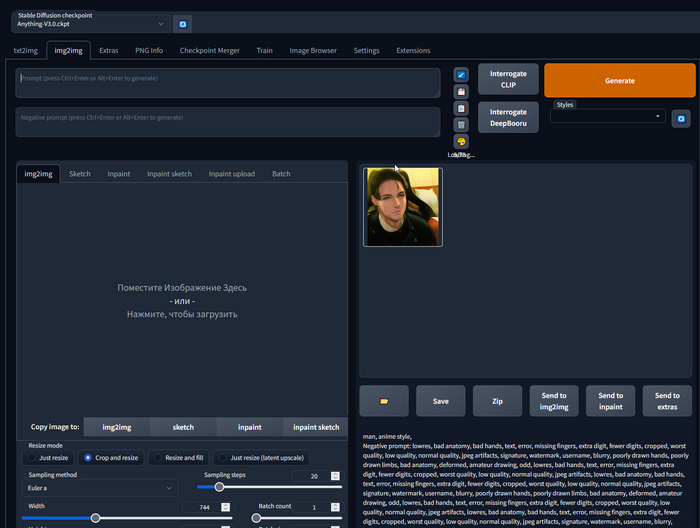

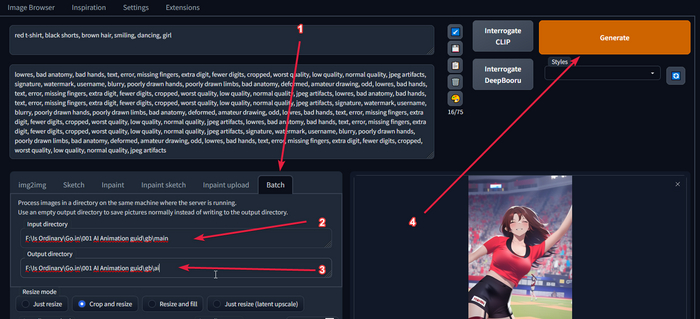

Третий этап (3) - Работаем в Stable Diffusion, за основу в гайде взята модель Anything V3, ссылка на неё: https://civitai.com/models/66/anything-v3

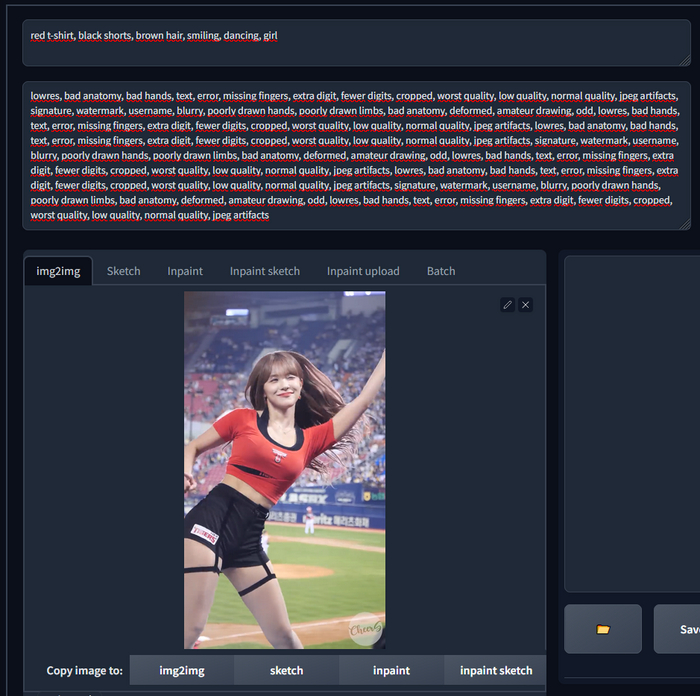

Внутри нейронки переходим во вкладку img2img, после чего закидываем кадр нашей секвенции в место для изображения.

Далее нам необходимо прописать promt и negative promt, второе это набор правил исключений, то чего не должно быть в финальном результате, всякие искажения, отсутствие головы и не каких футанари.

Такой промт можете найти в моём телеграмме, там я поделился 3 самыми лучшими и эффективными под многие задачи. https://t.me/goin_blog/4

В верхний промт указываем то что находится на изображении, описываем на простом английском. Переводчик в помощь.

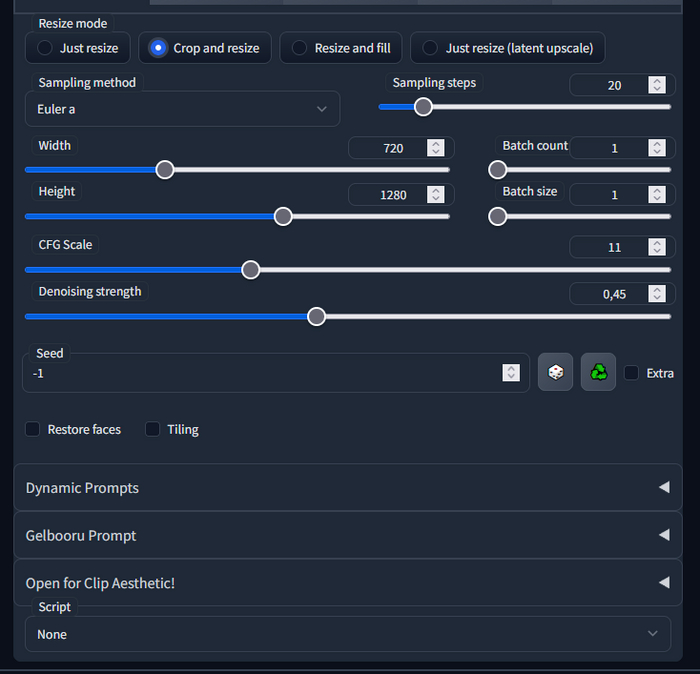

После заполнения опускаемся ниже к настройкам, количество шагов делаем 20, больше для аниме не нужно, семплинг метод тоже не меняем. Ширину и высоту выставляем по аналогу с видео. Дальше идут важные настройки. CFG Scale и Denoising strength, первая отвечают за силу промта, а так же контрастность. Вторая за то на сколько далеко нейронка отойдёт от оригинала. Мои настройки по умолчанию ниже, тут нужно играться и настраивать для себя.

Теперь мы смело можем приступить к генерации отдельных кадров анимации.

Четвёртый этап (4) - Тыкаем

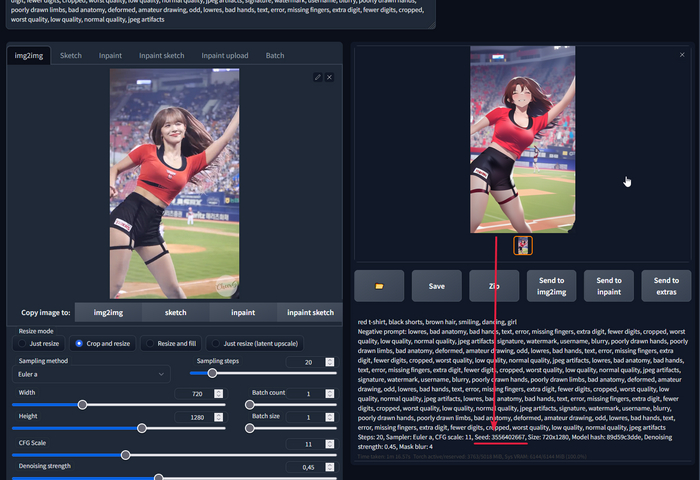

Если нас удовлетворил результат генерации, то сохраняем его сид, его можно посмотреть тут:

И его вставляем в настройках прямо под Denoising strength. Это поможет немного упохожить изображение анимации. Пробуем ещё пару разных кадров из анимации, если всё ок, приступаем к следующему этапу.

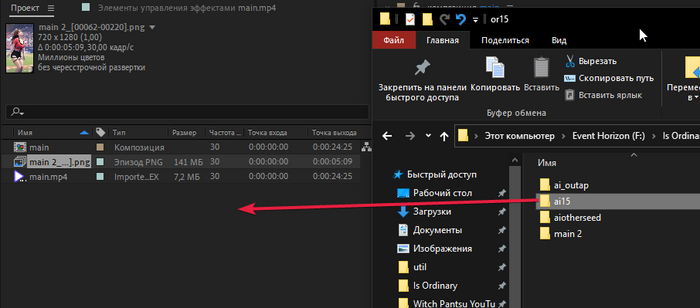

Пятый этап (5) - тут всё просто, переходим во вкладку Batch и указываем путь к нашей секвенции. Ниже куда выводить анимации, после чего тыкаем генерировать и ждём "долгое время".

После успешной генерации всех кадров, мы уже можем полистать их пальчиками и увидеть +- конечный результат. Переходим к сборке и постобработке.

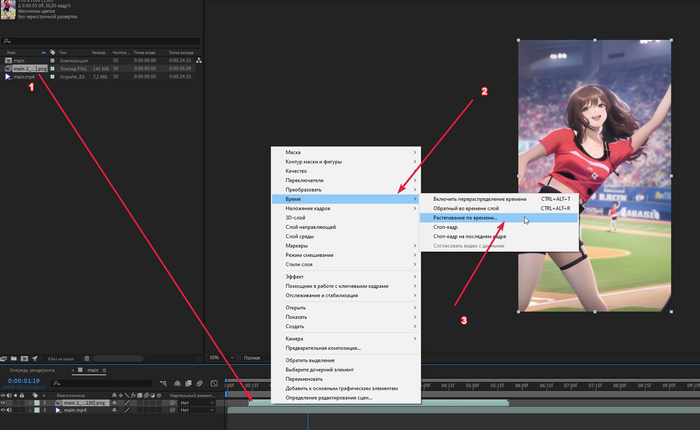

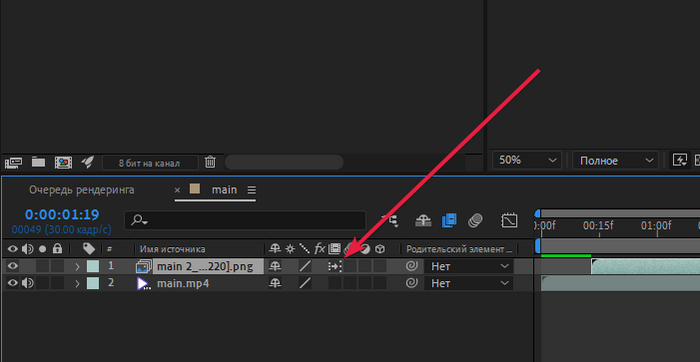

Шестой этап (6) - Возвращение в видеоредактор. И загружаем туда нашу отгенерированную секвенцию. В афтер можно прям перетянуть, он сам её определит.

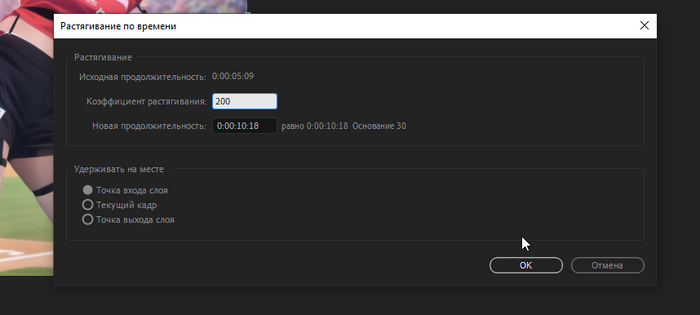

После этого можем перетянуть нашу секвенцию на таймлайн. После чего правой кнопкой мыши по ней, время и растягивать по времени. По сколько мы делали 15 кадров, а композиция 30, наше видео сейчас в x2 скорости, нужно замедлить на 200%

После этого момента уже можно наслаждаться результатом, любуясь свеже-сгенерированным видосиком. Однако есть ещё что делать. На этом этапе мы можем отредактировать финал результат, тут всё зависит от ваших проф. навыков в монтаже. Если что гуглим уроки как добавить резкость или поменять цвета. По вашим потребностям.

А ещё мы можем попробовать добавить кадры, при помощи функции AF. Тыкнув 2 раза сюда до такой иконки.

Это создаст промежуточные кадры в вашей секвенции. Однако результат не всегда хорош. Иногда это смотрится прям паршиво. Так что на глаз.

В целом это весь процесс создания ai анимации на основе реффа. Дальше уже всё зависит от вашей идейности. Надеюсь незадшнил и все всё было понятно. Если уж где какие праблы. Пишите в телеграмм, в обсуждения, там оперативно отвечу и помогу.

Если вдруг гайд был полезен. Буду рад видеть на своём ютуб канале. В дальнейшем там будет больше полезного. Поделюсь своим опытом в фрилансе, геймдеве, дизайне, оценки алгоритмов и т.д.. Есть что ещё рассказать))