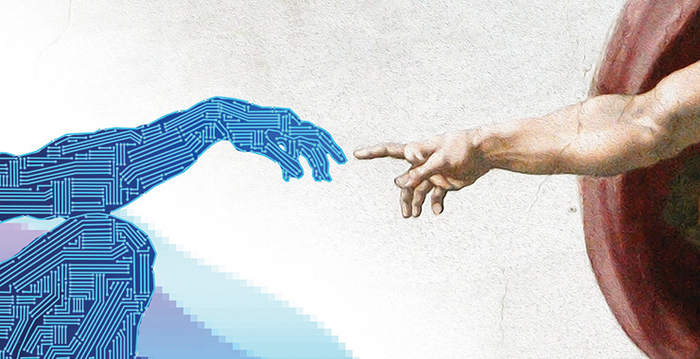

Искусственный интеллект меняет все аспекты психологии. И вот на что следует обратить внимание...

Психологи и их навыки незаменимы, но также необходимо осуществлять вдумчивое и стратегически грамотное внедрение ИИ в эту сферу.

Зара Абрамс, для журнала Американской Ассоциации Психологов (в печатной версии - Vol. 54 No. 5 стр. 46)

В психологической практике чат-боты с искусственным интеллектом (ИИ) могут сделать терапию более доступной и менее затратной. Инструменты ИИ также могут повысить эффективность интервенций, автоматизировать административные задачи и помочь в обучении новых врачей-клиницистов. Синтетический интеллект предлагает новые способы понимания человеческого интеллекта, а машинное обучение позволяет исследователям извлекать информацию из огромных массивов данных. В то же время педагоги изучают возможности использования ChatGPT в учебном процессе.

"Многие люди сопротивляются, но мы не можем это контролировать. Это будет происходить независимо от того, хотим мы этого или нет", - говорит Джессика Джексон, доктор философии, лицензированный психолог и сторонник справедливых технологий, которая работает в Техасе. "Если мы будем продуманно и стратегически подходить к интеграции ИИ, мы сможем оказать реальное влияние на жизнь людей во всем мире".

Несмотря на потенциал ИИ, поводы для беспокойства все же есть. Инструменты ИИ, используемые в здравоохранении, дискриминируют людей по признаку расы и инвалидности (Grant, C., ACLU News and Commentary, October 3, 2022). Нелегальные чат-боты распространяли дезинформацию, признавались пользователям в любви и сексуально домогались несовершеннолетних, что побудило лидеров науки и технологий в марте 2023 года призвать к приостановке исследований в области ИИ.

"Прогресс во многом определяется возможностями этих систем, которые опережают наше понимание того, как они работают", - говорит Том Гриффитс, доктор философии, профессор психологии и информатики, руководитель лаборатории вычислительной когнитологии Принстонского университета. "Сейчас имеет смысл параллельно осуществлять крупные инвестиции в понимание этих систем, и психологи вполне могут помочь в этом".

Выявление предвзятости

По мере того как алгоритмы и чат-боты наводняют систему, возникает несколько важнейших вопросов. Безопасен ли ИИ для использования? Этично ли это? Какие меры защиты могут помочь обеспечить конфиденциальность, прозрачность и справедливость при все более широком использовании этих инструментов в обществе?

Психологи, возможно, являются одними из наиболее квалифицированных специалистов, способных ответить на эти вопросы, поскольку они имеют подготовку по различным методологиям исследований, этичному обращению с участниками, психологическому воздействию и т.д.

"Одна из уникальных задач психологов на протяжении всей нашей истории - выявление вреда, который может быть нанесен тем, что кажется равным или справедливым", - говорит Адам Майнер, доктор психологических наук, клинический доцент кафедры психиатрии и поведенческих наук Стэнфордского университета, ссылаясь на открытое письмо, написанное Кеннетом Кларком, доктором философии, и Мэми Фиппс Кларк, доктором философии, в связи с судебным процессом "Браун против Совета по образованию".

Что касается искусственного интеллекта, то психологи обладают достаточным опытом, чтобы подвергнуть сомнению предположения о новых технологиях и изучить их влияние на пользователей. Психолог Арати Сетумадхаван (Arathi Sethumadhavan), доктор философии, бывший директор по исследованиям в области ИИ в группе Microsoft по этике и обществу, проводила исследования DALL-E 2, GPT-3, Bing AI и других нейронных сетей.

По словам Сетхумадхавана, психологи могут помочь компаниям понять ценности, мотивы, ожидания и страхи различных групп, на которые могут повлиять новые технологии. Они также могут помочь в подборе участников с учетом таких факторов, как пол, происхождение, возраст, личные качества, стаж работы, взгляды на частную жизнь, неврологическое разнообразие и т.д.

Руководствуясь этими принципами, Сетумадхаван учитывает мнения различных заинтересованных сторон, стремясь ответственно подходить к процессу подготовки продуктов. Например, при разработке новой функции преобразования текста в речь она провела интервью с актерами озвучивания и людьми с нарушениями речи, чтобы понять и учесть как преимущества, так и вред новой технологии. Ее команда узнала, что люди с нарушениями речи с оптимизмом смотрят на использование продукта для повышения уверенности в себе во время собеседований и даже для свиданий, и что синтетические голоса, способные меняться со временем, лучше подойдут детям, пользующимся сервисом. Она также применила методы выборки, часто используемые психологами, для увеличения доли афроамериканцев в массивах данных системы распознавания речи.

"Кроме того, важно учитывать точку зрения людей, которые периферийно вовлечены в жизненный цикл разработки ИИ", - говорит Сетумадхаван, - "включая людей, которые предоставляют биометрические данные (например, свои фотографии для обучения систем распознавания лиц), модераторов, которые также собирают данные, и специалистов по их обработке, которые маркируют эти данные (например, отфильтровывают неприемлемый контент)".

Психологи также внимательно изучают взаимодействие человека и машины, чтобы понять, как люди воспринимают ИИ и какие последствия это может иметь для общества. В одном из исследований, проведенном психологом Йохананом Бигманом, доцентом Еврейского университета в Иерусалиме, было обнаружено, что люди меньше возмущаются гендерной дискриминацией, вызванной алгоритмом, чем дискриминацией, созданной человеком (Journal of Experimental Psychology: General, Vol. 152, No. 1, 2023). Участники исследования также считают, что компании несут меньшую юридическую ответственность за дискриминацию, вызванную алгоритмами.

В другом исследовании Бигман и его коллеги проанализировали взаимодействие в отеле в Малайзии, где работали как роботы, так и люди. После того как гости отеля пообщались с роботами, они стали относиться к работникам-людям с меньшим уважением (рабочий документ).

"Возник побочный эффект, при котором у нас вдруг появились агенты, представляющие собой инструменты, и это может привести к тому, что мы станем рассматривать людей тоже в качестве инструментов", - сказал он.

По словам Сетумадхаван, по-прежнему остается много вопросов относительно того, что заставляет людей доверять ИИ или полагаться на него, и ответы на них будут иметь решающее значение для ограничения вреда, включая распространение дезинформации. По словам Бигмана, регулирующие органы также пытаются решить, как ограничить возможности ИИ и кто будет нести ответственность, если что-то пойдет не так.

"Если человек дискриминирует меня, я могу подать на него в суд", - сказала она. "Если же меня дискриминирует ИИ, насколько легко мне будет это доказать?"

ИИ в клинике

Психологическая практика созрела для внедрения инноваций в области ИИ, включая терапевтические чат-боты, инструменты, автоматизирующие ведение записей и другие административные задачи, а также более интеллектуальное обучение и вмешательство, но клиницистам нужны инструменты, которые они смогут понять и которым смогут доверять.

Хотя чат-ботам не хватает контекста, жизненного опыта и речевых нюансов человеческих терапевтов, у них есть потенциал для заполнения пробелов в предоставлении услуг в области психического здоровья.

"Суть в том, что у нас не хватает консультантов", - говорит Джексон. "Хотя терапия должна быть доступна всем, не все в ней нуждаются. Чат-боты могут заполнить эту потребность". Для решения некоторых проблем с психическим здоровьем, таких как проблемы со сном или дистресс, связанный с хронической болью, может быть достаточно обучения с помощью чат-бота.

Помимо того, что чат-боты делают психиатрическую помощь более доступной и недорогой, они могут помочь людям, которые, возможно, стесняются обращаться к психотерапевту, например, тем, кто впервые обращается к психотерапевту, или людям с социальной тревожностью. По словам Джексона, они также дают возможность переосмыслить саму область, намеренно создавая компетентные в культурном отношении ИИ, которые могут сделать психологию более инклюзивной.

"Меня беспокоит то, что ИИ не будет инклюзивным", - сказал Джексон. "В конце концов, ИИ нужно обучать. Кто будет его программировать?"

Среди других серьезных проблем - это сознательное согласие и конфиденциальность пациента. Понимают ли пользователи, как работает алгоритм и что происходит с их данными? В январе некоммерческая организация Koko, занимающаяся вопросами психического здоровья, вызвала недоумение после того, как предложила консультацию 4 тыс. человек, не предупредив их о том, что им будет оказывать помощь ChatGPT-3. Появились также сообщения о том, что терапия с помощью генеративных языковых моделей (которые при каждом взаимодействии выдают разные тексты, что затрудняет проверку их клинической валидности или безопасности) привела к самоубийствам и другим вредным последствиям.

Однако в психологии есть и истории успешной интеграции ИИ. Чатбот Wysa не использует генеративный ИИ, а ограничивает взаимодействие высказываниями, составленными или одобренными психотерапевтом. Wysa не собирает адреса электронной почты, номера телефонов и реальные имена, а также редактирует информацию, которую пользователи сообщают, чтобы их можно было идентифицировать.

Приложение, обеспечивающее когнитивно-поведенческую терапию тревоги и хронической боли, получило от Управления по санитарному надзору за качеством пищевых продуктов и медикаментов США сертификат Breakthrough Device Designation. Оно может использоваться как самостоятельный инструмент или интегрироваться в традиционную терапию, где врачи могут отслеживать прогресс своих пациентов между сеансами, например, выполнение упражнений по когнитивному рефреймингу.

"Wysa не призвана заменить психологов или человеческую поддержку. Это новый способ получения помощи", - говорит Смрити Джоши, магистр философии, главный психолог компании.

ИИ также способен повысить эффективность работы клиники за счет снижения бремени административных задач. Инструменты обработки естественного языка, такие как Eleos, могут прослушивать сеансы, делать заметки и выделять темы и риски для рассмотрения практикующими врачами. Другие задачи, которые можно автоматизировать, включают анализ результатов терапии, отслеживание симптомов у пациентов и управление лечебной практикой.

Прежде чем внедрять инструменты искусственного интеллекта в свой рабочий процесс, многие врачи хотят получить больше информации о том, как обрабатываются данные пациента и какие приложения безопасны и этичны для использования. По словам Майнера, в этой области также необходимо более глубокое понимание частоты и типов ошибок, которые обычно допускают эти инструменты. Это поможет убедиться в том, что такие инструменты не лишат права голоса те группы людей, которые уже лишены доступа к медицинским системам, например, людей, для которых английский язык является вторым языком или которые используют в своей речи фразеологию, характерную для той или иной культуры.

Майнер и его коллеги также используют искусственный интеллект для оценки эффективности сеансов терапии и определения областей, в которых следует улучшить обучение стажеров (npj Mental Health Research, Vol. 1, No. 19, 2022). Например, модели естественного языка могут просмотреть тысячи часов сеансов терапии и выявить упущенные возможности для диагностики пациента или неумение задавать ключевые вопросы, например, о том, есть ли у пациента, склонного к суициду, дома огнестрельное оружие. Подобные обучающие программы, такие как Lyssn, оценивающие соблюдение врачами доказательных протоколов, уже начинают появляться на рынке.

"На мой взгляд, именно в этом случае ИИ действительно приносит пользу", - говорит Майнер. "Потому что он не обязан быть идеальным и позволяет человеку оставаться за рулем".

Трансформация исследований

ИИ открывает перед исследователями новые данные о поведении человека и дает возможность их анализировать. Психологи долгое время измеряли поведение с помощью самоотчетов и лабораторных экспериментов, но теперь они могут использовать ИИ для мониторинга таких вещей, как активность в социальных сетях, расходы по кредитным картам, данные GPS и метрики со смартфонов.

"Это многое меняет, потому что теперь мы можем изучать индивидуальные различия в повседневном поведении", - говорит психолог и исследователь личности Сандра Мац, доктор философии, доцент Колумбийской школы бизнеса.

Мац сочетает анализ большого объема данных о повседневной жизни с более традиционными методами, такими как эколого-психологический тест (ЭПТ). Сочетание этих источников данных позволяет составить картину того, как разные люди реагируют на одну и ту же ситуацию, и в конечном итоге сформировать персонализированные вмешательства в различных отраслях, например, в образовании и здравоохранении.

ИИ также открывает возможности для пассивного мониторинга, который может спасти жизнь. Росс Якобуччи, доктор философии, и Брук Аммерман, доктор философии, оба являются доцентами психологии в Университете Нотр-Дам, тестируют алгоритм, который собирает скриншоты интернет-активности пациентов, чтобы отметить употребление или просматривание терминов, связанных с самоубийством и самоповреждением. Соединив эти данные с ЭПТ и физиологическими показателями "умных" часов, они надеются создать инструмент, способный в режиме реального времени предупреждать врачей о риске самоубийства у пациентов.

"Пассивное зондирование - это настоящее золотое дно", - говорит Якобуччи. "Как с его помощью можно узнать не только о том, кто подвержен риску, но и, что более важно, когда он подвержен риску?"

Модели обработки естественного языка также оказываются полезными для исследователей. Группа специалистов из Дрексельского университета в Филадельфии показала, что GPT-3 может предсказывать деменцию, анализируя речевые паттерны (Agbavor, F., & Liang, H., PLOS Digital Health, Vol. 1, No. 12, 2022). Когнитивные психологи проверяют работу GPT в канонических экспериментах, чтобы узнать больше о том, как его способности к рассуждениям сопоставимы с человеческими (Binz, M., & Schulz, E., PNAS, Vol. 120, No. 6, 2023). Гриффитс использует GPT в качестве инструмента для понимания пределов человеческого языка.

"Эти модели могут делать много впечатляющих вещей", - говорит Гриффитс. "Но если нам хочется быть уверенными в том, что мы можем делегировать им задачи, мы должны больше узнать об их представлении мира - и о том, как оно может отличаться от нашего представления о нем, - прежде чем это станет проблемой".

"Люди, изучающие психологию, не знают терминологии компьютерных наук, и наоборот - очень мало людей, которые находятся на стыке этих двух областей", - сказал Якобуччи.

В конечном счете, ИИ поставит перед психологами сложные задачи, но решение этих задач несет в себе потенциал для трансформации этой области.

"ИИ никогда полностью не заменит человека, но он может потребовать от нас повышения осведомленности и обучения тому, как безопасно использовать его", - сказал Джоши. "Если мы справимся с этой задачей, то ИИ сможет во многом поднять уровень развития психологии".

Наука | Научпоп

7.7K постов78.6K подписчиков

Правила сообщества

Основные условия публикации

- Посты должны иметь отношение к науке, актуальным открытиям или жизни научного сообщества и содержать ссылки на авторитетный источник.

- Посты должны по возможности избегать кликбейта и броских фраз, вводящих в заблуждение.

- Научные статьи должны сопровождаться описанием исследования, доступным на популярном уровне. Слишком профессиональный материал может быть отклонён.

- Видеоматериалы должны иметь описание.

- Названия должны отражать суть исследования.

- Если пост содержит материал, оригинал которого написан или снят на иностранном языке, русская версия должна содержать все основные положения.

Не принимаются к публикации

- Точные или урезанные копии журнальных и газетных статей. Посты о последних достижениях науки должны содержать ваш разъясняющий комментарий или представлять обзоры нескольких статей.

- Юмористические посты, представляющие также точные и урезанные копии из популярных источников, цитаты сборников. Научный юмор приветствуется, но должен публиковаться большими порциями, а не набивать рейтинг единичными цитатами огромного сборника.

- Посты с вопросами околонаучного, но базового уровня, просьбы о помощи в решении задач и проведении исследований отправляются в общую ленту. По возможности модерация сообщества даст свой ответ.

Наказывается баном

- Оскорбления, выраженные лично пользователю или категории пользователей.

- Попытки использовать сообщество для рекламы.

- Фальсификация фактов.

- Многократные попытки публикации материалов, не удовлетворяющих правилам.

- Троллинг, флейм.

- Нарушение правил сайта в целом.

Окончательное решение по соответствию поста или комментария правилам принимается модерацией сообщества. Просьбы о разбане и жалобы на модерацию принимает администратор сообщества. Жалобы на администратора принимает и общество Пикабу.