Более подробная видеоверсия:

Краткая текстовая версия:

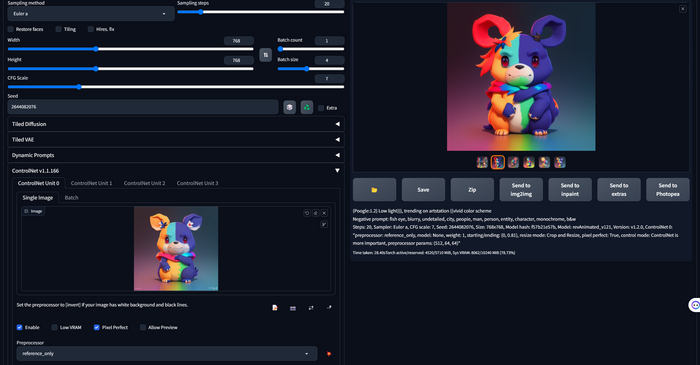

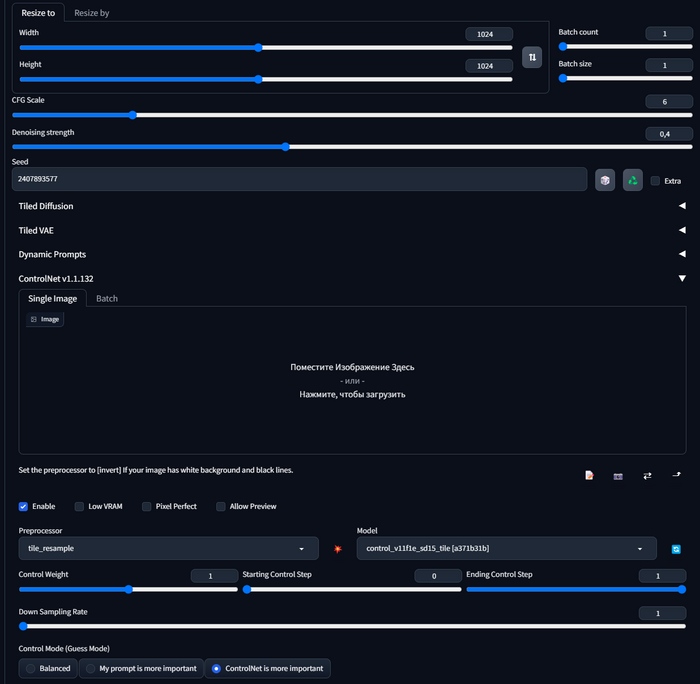

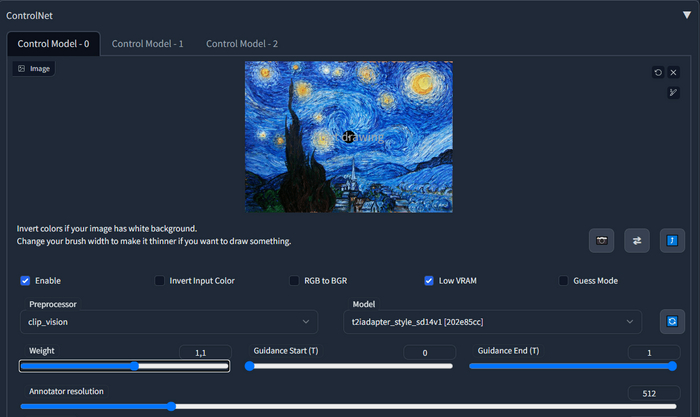

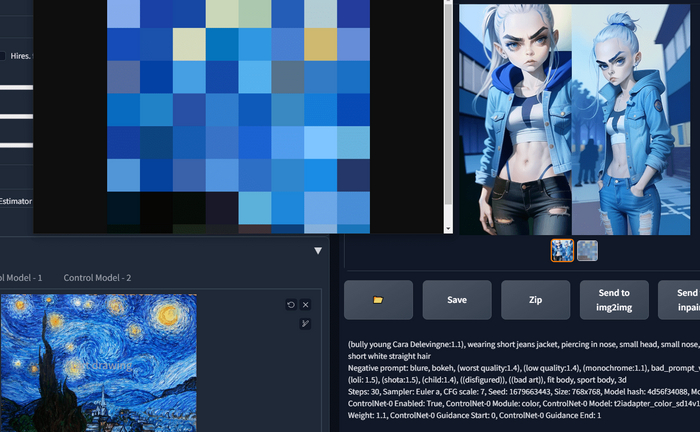

В automatci1111 из вкладки Extensions установите два расширения Dynamic Prompts и Booru tag autocompletion. На самом деле первое расширение включает в себя еще одно Wildcards. И они все отлично дополняют друг друга.

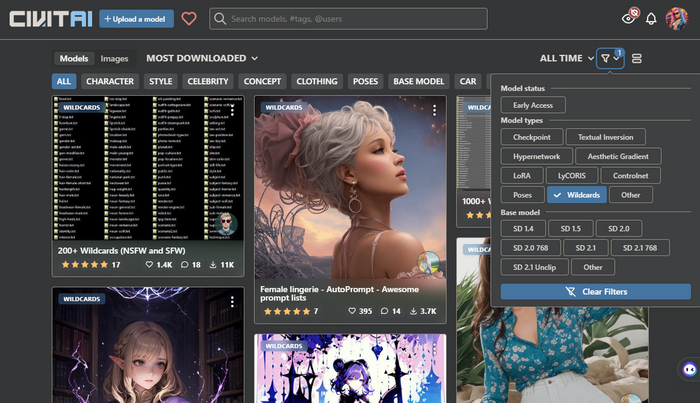

На civitai скачайте набор карточек которые будут содержать в себе списки ключевых слов, например файл color содержит множество цветов и благодаря нашим расширениям вы теперь будете иметь быстрый доступ к ним.

Скачанные файлы поместите в папку stable-diffusion-webui\extensions\sd-dynamic-prompts\wildcards

Теперь, после перезагрузки интерфейса вы можете написать cat __color__ и генерировать и каждую генерацию из файла color.txt будет выбираться случайный цвет. Или что-то посложнее __animal__ __background__ __setting__ __artist__. И каждую генерацию будем получать случайное животное в случайном месте в случайном сетинге приправленное случайным стилем.

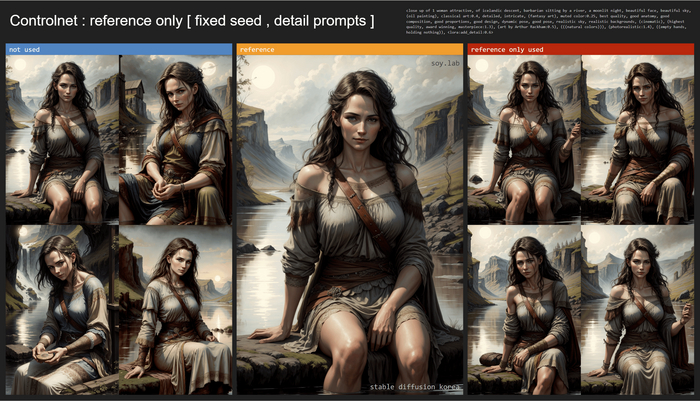

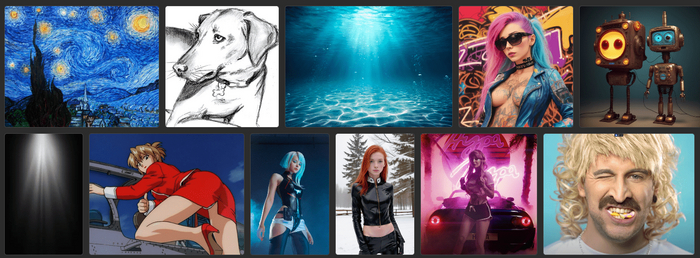

Пример генераций по этому запросу:

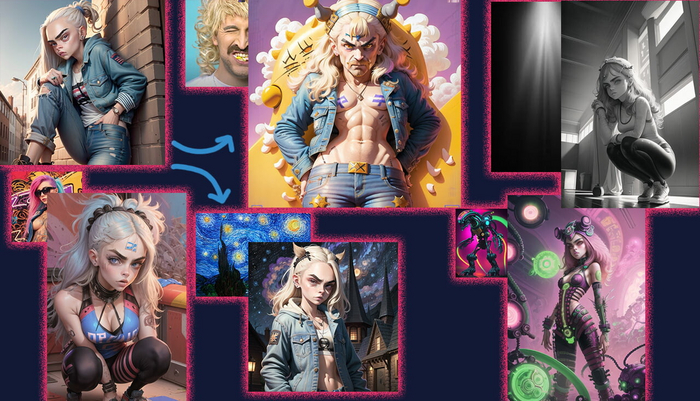

Такой способ использования это пальцем в небо. Для себя я обычно заменяю подобным одно два понятия в своих промптах, одежду, стиль или сеттинг, чтобы перебрать варианты и найти неочевидно классный и уже дальше с ним играться. Это была работа расширения wildcards.

Dynamic prompt

Но кроме него мы установили и Dynamic prompt. Он работает сложнее, как именно рассказал на видео. Для него мы сами пишем список вариантов которые хотим видеть в нужном нам месте и так же каждую генерацию выбирается один из них. Например, если использовать вот этот промпт:

{1-2$$professional high quality|majestic|stunning view|spectacular} { (HDR photo)|digital art|digital painting|1.05::analog photo|photorealistic painting|0.5::hyperrealistic scenery|1.1::digital photography} {containing|of} a picturesque nature of a

{1-3$$humid tropical jungle|foggy fjord|ocean bay|seashore|desert landscape|cherry blossom on cliff|ocean shore|wild life scenery|bare tree and desert|river in forest|body of water surrounded by trees and rocks|landscape photo of northern forest|lush vegetation view|calm body of water surrounded with trees and stones|silhouette of an old bare tree on body of water near cliff|sun rays through trees, voluminous light and light rays|steep rocky walls gorge|tropic island beach with a few palms|foggy swamp|peaceful lushious forest|lush green deep forest|prairie|alpine meadow|savannah {mirage|}|lush bloom oasis|amazon river forest|quaint northern hills in the moss|reflective lake|spectacular river view|endless plain|picturesque forest edge with an old driftwood|dark thicket} in a

{winter|spring|summer|autumn} [imagination] {in the morning {dawn| <lora:theovercomer8sContrastFix_sd15:0.4> }|in the afternoon|in the evening {sunset| <lora:theovercomer8sContrastFix_sd15:0.6> }|at the night, {moonlit|} <lora:theovercomer8sContrastFix_sd15:0.7> }, {clear|cloudy { (raining) |}|partly cloudy {windy||}|overcast|snowing { (blizzard) |}|foggy|0.7::stormy and lightning| (hurricane) } weather,

{1-2$$global lighting|environmental lighting|dramatic lighting|(god rays:0.9)}, 8k resolution, detailed, focus, (close shot)

{1-2$$featured on flickr|environmental art photography|shutterstock contest winner|deviantart|hudson river school painting|pixiv|atmospheric dreamscape painting|pinterest|0.5::inverted darkness (extravaganza) }

{1-2$$by Michael James Smith|by Mark Keathley|by Thomas Vijayan|by Guy Tal|by Mandy Lea|by Thomas Kinkade|by Ted Gore|by Jake Guzman|by Marc Adamus|by Ryan Dyar}

Negative prompt: fish eye, blurry, {undetailed|haze}, city, people, man, person, entity, character, monochrome, b&w, animal

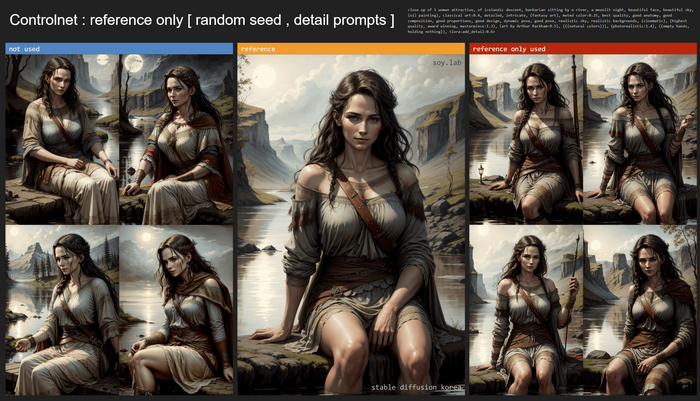

И если сгенерируем 6 картинок, то получим:

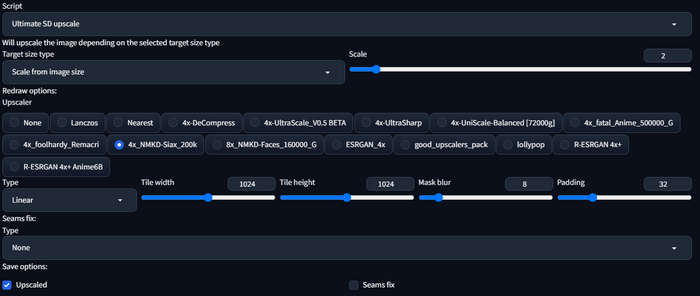

Можно открывать сайт с обоями. Кстати как качественно увеличить их разрешение с помощью нейросети писал совсем недавно тут.

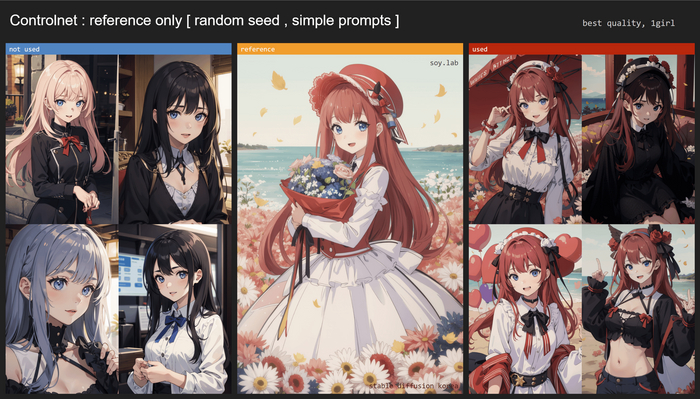

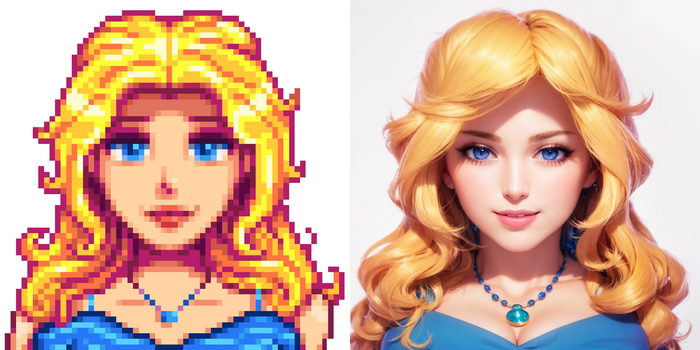

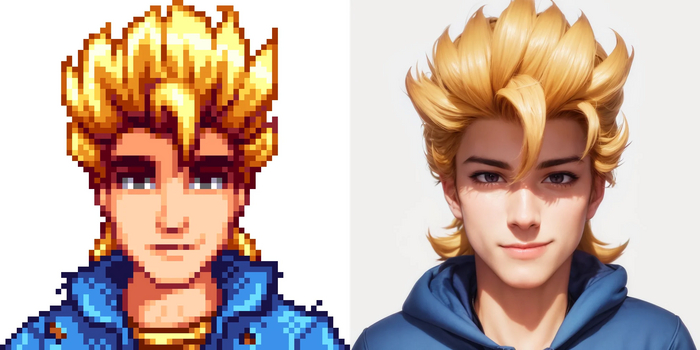

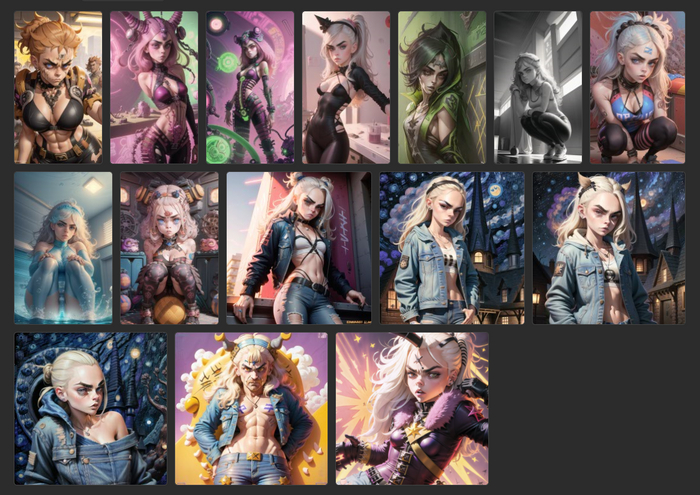

Или еще пример, когда-то давно делал генератор девушек.

{curvy|_} {(tall:1.1)|(short:1.1)}{(Latina:1.1)|Asian|European|European|(Latina:1.1)} full body photo of cute woman, wide angle, {tanned skin|brown skin|pale skin|tanned skin|brown skin|pale skin|black skin}, (freckles and moles and skin pores:1.1)wearing shoes and {(tank top:1.1)|(dress:1.1)|(overall:1.1)|(blouse:1.1)|(bustiers:1.1)|(bra:1.1)|(swim suit:1.1)|(sheath dress:1.1)|(mini sun dress:1.1)} and {jeans mini shorts|mini skirt|mini pleated skirt|mini circle skirt|tulip skirt|pencil skirt}, small breast, solo, 1girl, {short hair|long hair}, {redhead|white hair|black hair}. Highly Detailed, detailed skin, detailed eyes, 20 megapixel, canon eos r3, detailed skin, detailed face, raw photo, bold, bright colours, dslr, dramatic lighting, high quality, film grain, Fujifilm XT3, (strong backlight:1.1), analog style, dimly lit

Работает так. В фигурных скобках через прямую линию пишем варианты для выбора, при генерации из каждых скобочек выбирается один из них. Чтобы выбирать не один, а несколько пишем 2$$ - будет выбрано 2. Или 1-3$$ - будет выбран случайным образом от 1 до 3.

Мне это все очень часто пригождается в коммерции. А вайлдкардс использую и для простых генераций.

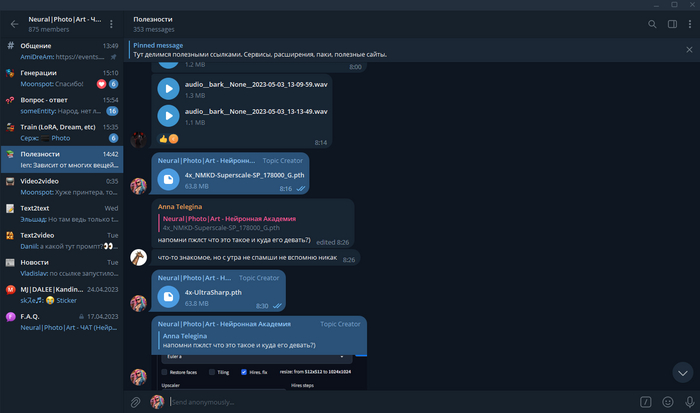

Мой канал с гайдами по нейросетям. Где бесплатно обучаю с нуля и до самостоятельного обучения моделей.

Если хотите быстро влиться, то у меня есть два видео, одно как установить, а второе как настроить и работать с SD.