Ой да ладно, серваки с большими дисками в хецнере решают, там цена за гигабайт копеечная выходит

Хотел сначала дать развернутый ответ. Но понял что вы написали такой бред что его даже комментировать не хочется.

Скажем так, если вы предложите купить "серваки с большими дисками в хецнере" в компании где используются такие технологии как ceph и IPoIB, то вы пойдете на hh искать новую работу.

то вы пойдете на hh искать новую работу

Для того, чтобы ляпнуть подобное в компании с подобной инфраструктурой, туда еще надо устроиться. Что маловероятно.

У Backblaze 5 US$.

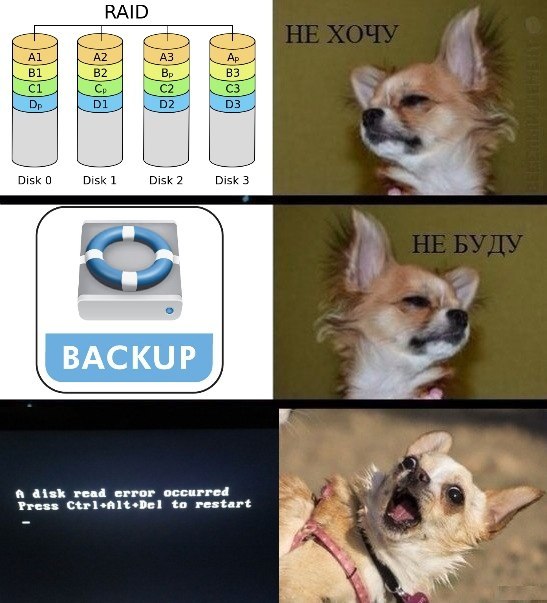

Но если данные реально важны, то стоит хранить 2 бэкапа и диски в RAID 6 или ZFS имхо.

Не люблю рейды больше 1. Зеркало на паре дисков + бекап тут + бекап где-нить вдалеке. Если что - выдернул диск и прочитал его где хочешь.

Мне этого хватает выше крыши, у меня нет больших баз и файлов.

От этого, вроде бы защищены решения от Nutanix. Но я с ними не работал, так что сказать ничего точно не могу. Хотя сама идея неплохая.

Но ддля нормальной работы, как я понял из даташитов, нужен кластер минимум из 3 хостов, плюс 10гбит сеть между ними. Соответственно связи с вылетевшими 2 дисками из пары - тут нет никакой.

При наличии резервного хоста, диски могут сыпаться очень хорошо, всё остальное соберется.

А если нутаникс будет на одном хосте и там дропнется критическое количество дисков, то никакой нутаникс (несмотря на то, какой он божественный) не поможет. ТАк же как ни EMC, HPE, DELL, Hitachi и остальные вендоры

10G сейчас стоит уже далеко не заоблачных денег. Я и сам, в общем-то не отказался бы поиграться с ним, но на реальном продуктивном железе мне никто поиграться с ним не даст на работе. А так да, самам концепция интересна.

На одном хосте, разумеется, он потеряет половину своих преимуществ.

2 SSD - 1 внутри сервака + 1 снаружи на отдельном питании по usb 3.0

Правда объем дампа не так велик.

Нуууу... раз у нас столько денег на raid 15, то тогда уж лучше докинуть пару дисков и сделать 60.

6 будет отказоустойчивее, а 0 добавит скорости чтения/записи.

А то получается, что ставим страшный raid 5, но чтобы ночью можно было спать, зеркалируем каждый диск в 1, чем гробим скорость записи. Смысл?

p.s.

да ладно, я знаю, что ты пошутил

А так. Меняешь один диск. Ребилд. Потов второй, ребилд. и потом вроде как expand как при добавлении диска http://ask.adaptec.com/app/answers/detail/a_id/15127/~/how-t...

Но перед этим всем один хер надо бекап делать. Ибо черт его знает что пойдет не так. А если делать бекап. То как я и сказал просто слив на другой готовый сервер проще. Поэтому на практике ни разу не пробывал.

Хотя особо проблем быть не должно.

с учетом вероятность ошибки чтения 10^-15 использовать raid 5 как-то не безопасно

Пацаны рекомендуют raid6 минимум

У RAID 5 проблема в том, что пока идёт ребилд может сдохнуть ещё один диск, что совсем не круто.

А учитывая, что в системе стоят диски, которые, как правило, сошли с конвейера с разницей в несколько секунд, везлись до стойки и потом всю жизнь эксплуатировались в одних условиях, то при выходе из строя одного из этих дисков и ребилде рейда на новый (т.е. повышенной нагрузке) вероятность того, что они все разом начнут сыпаться, слишком далека от нуля. Так что для рейда 5 надо брать разные диски с разной родословной и биографией :DD И желательно не сильно ушатанные.

Нормально в среднем. Во-первых RAID5 НЕ ЗНАЧИТ три диска в паке, учим матчасть[!!!!!!], RAID5 адаптека штатный например вообще сводит к полосам по винчестерам перекрёстным как в 6, только принцип взаимодействия зон другой. Во-вторых у меня собственно классический трёхдисковый стоит уже лет десять дома, расширяю, диски меняю вылетевшие - парно ни разу не было ещё.

Пожалуй, предложу вам самим подучить матчасть, RAID 5 может восстановиться только после смерти одного диска в массиве. Минимальное количество дисков 3, но это не отменяет того факта, что если во время ребилда одного из дисков умрёт другой, то ситуации не позавидуешь.

Диски у вас на сколько терабайт? Сколько по времени занимает ребилд диска с небольшим объёмом, типа двух терабайт?

Предложи. Ламер ты только, заслужил титул. Ознакомься с реализацией raid5 на произвольном количестве дисков. http://www.nix.ru/computer_hardware_news/hardware_news_viewe...

Но таки количество копий блока - 1 XOR. Потому я предпочитаю 6, там 2XOR или 2+1 XOR. Однако из-за seeking'a на HDD такие реализации медленнее чем полнодисковые 3/2 RAID5.

Ребилд занимает на медленном железе несколько часов без нагрузки, нет проблем с этим. Дома они давно в десинке разных поколений и моделей, хотя начинались с одинаковых. В продакшне см. выше. Любой кратный RAID делается по принципу выделения блоков на дисках в первую очередь и потом уже по логике соответствующего уровня, там вылет диска оптимально обыгран с точки зрения надёжности по типу размещения остальных блоков данного массива.

Ребилд занимает на медленном железе несколько часов без нагрузки,

Вот только такую радость в продакшене почти не встретишь. А под серьезной нагрузкой он может и на сутки-другие растянуться.

Ну логично. Для такого есть rebuild cap по скорости итд. На деле конечно же нагрузку надо снимать и там если важно, иметь резерв и online hot copy или что-то подобное. Потому как IOPS просто в жопе даже на 5% капа на HDD, seeking, а это равно не работает в раскладе собственно нагрузки, само оно не работает или при нагрузке завалится - никого впродакшне не волнует.

Ну так по этому, лично я на больших количествах шпинделей, предпочитаю использовать все таки RAID 6. Вернее, RAID-DP, но это чисто фишка Netapp'a.

Они менее критичны к вылету дисков во время ребилда.

Разницы то... 2 кросс-XOR , а не один. По скорости зато сильно сдаёт, определяется собственно вышеописанным про блоки на дисках, а не целые диски, адский seeking обычно даже в идеальном варианте.

Ну, никто ведь не мешает использовать разные типы RAID в разных рейд-группах, если того требует ситуация. А как основное, медленное хранилище - более чем меня устраивает. Зато надежно.

Да и DP - достаточно быстрый. По крайней мере быстрее стандартной шестерки.

Ламер ты только, заслужил титул.

Можете указать в чём я конкретно не прав перед тем как вешать ярлыки?

"Минимальное количество дисков 3, но это не отменяет того факта, что если во время ребилда одного из дисков умрёт другой, то ситуации не позавидуешь."

Такого вообще нету в области вышеописанной. Там не диски. Тогда уж правильно формулировать надо. Однако это очень тупое утверждение в принципе, ибо "если во время ребилда RAID1 умрёт другой диск..."

Хотите сказать, что пятёрка будет работать после смерти двух дисков? Шестёрка смерть двух винтов переживёт. А что там, если не диски?

То, что у тебя так, не значит что так везде. На больших количествах дисков, шансы, что вылетит два диска одновременно, входящих в одну рейд-группу, заметно повышаются.

Да и, дома у тебя нет серьезной нагрузки на них.

Ну да, домашний всё-таки. Так бы я делал софтрейд 6. ZFS стрёмно очень - уже ловил косяки. ReFS пока где-то в области фантазий на деле(читай бесполезна, есть уже в 2012R2) хотя слухов было...

Я и не предлагал использовать ZFS. По крайней мере без купленной поддержки от Oracle в продакшене.

У Oracle он используется в собственных хранилищах. Когда покупаешь их сервера, более плотная интеграция с СХД дает ряд плюшек. Хотя, я особо подробностей не знаю. При покупке подобного железа у нас за интеграцию Oracle и всех этих плюшек отвечал DBA.

Не, ты не путай таки. За свои хранилища они отвечают если что-то случится с данными, а за поддержку итд на соляре - нет, только за поддержку в настройке итд. Доказать что-то там нереально, это с СХД просто - упало - раком.

Ну, именно оракловыми железками я фактически не занимался. Не моя область деятельности. Поэтому мог и неточности допустить.

Как будто что-то плохое, на самом деле. Поднимается минут за 10 работы, почти с гарантией. А всякие хитрорейды хороши до тех пор, пока проблема в диске, а не контроллере - там начинаешь задумываться не только о цене дисков, но и о цене данных и простоев и страдать.

Плохое, конечно. Сложные схемы выдерживают одновременный отказ нескольких дисков. А RAID 1 лишь одного (либо N, но тогда цена за гигабайт в N раз выше).

Для дома - можно. Для бизнеса - по кукушке за такое.

Для бизнеса где отказ прям критичен что совсем совсем. Все равно делать репликацию на резервную железку. Так что опять же сильная избыточность на фиг не нужна.

Для бизнеса все равно многое через RAID 1 делается только чуть сложнее это выглядит, тот же RAID 10 это по суте RAID 1, только используются не 2 диска, а два массива RAID0.

Только пару миллионов лишних на диски понадобится. Да и по стоимости емких MDL дисков от вендоров первого эшелона, цена диска сильно отличается в большую сторону.

Да и контроллеров обычно бывает от двух и больше. А если уж совсем нужно катастрофоустройчивое решение, то строй метрокластер, с синхронной репликацией.

Ну обычный софт рейд - это отличный способ выстрелить себе в ногу, не находите? Банально питание пропадёт и проблемы обеспечены.

Изначально ведь разговор шел про RAID1. Чаще всего, его используют совместно с полусофтовыми встроенными RAID контроллерами, которые есть чистое зло. Да и вопрос стоял о "прочитается". А о электропитании должно позаботиться ИБП.

Зато, если есть аппаратный контроллер, вышедший в EOL, и волею коварного бога, нет в наличии ЗИП, ебля может быть куда как интересней.

На больших объемах согласен, но в пределах до десятка или двух терабайт сойдет.

Избыточность да, зато надежность. Да и на больших объемах все равно через RAID 1, все делается тот же 10 или 61.

Я сисадмин. Работаю в этой области с 2007 года... Могу рассказать пару историй, когда и как у меня падал 5 рейд. Делайте бекапы, господа!

На нагруженных нодах с малым количеством данных и высокой нагрузкой по IO, он не вывозит. (3-5 дисков). И получается не сильно дешевле.

На крупных файловых хранилищах (10-20 дисков и больше) Он очень не надежен. И лучше использовать рейд 60.

Но если у тебя хранилище дисков на 20, то на фига на нем собирать 5й рейд?

А если у тебя нужно поставить на сервер с большим числом дисковых операций только 4-5 дисков. То 5й рейд реально не лучший вариант который там можно придумать. Да как и 6й собственно.

Нафиг 60, они для активного хранилища не достаточно шустрые, а в случае замены диска, на время ребилда дикая деградация по скорости. В жопу. гигабайт сейчас не такой дорогой, 10 рулит

Кстати ещё одна проблема, это количество корзин на серверах. На новых лезвиях в блейдах лишнего места нет, их делают максимально плотно. Там каждая корзинка повышает стоимость самого сервера и его размещения в ЦОД + энергопотребление.

Блейд с дисками внутри, это как-то моветон. Разве что под гипервизор.

Если доросли до блейдов, то должно быть и внешнее хранилище.

А технология подключения его - уже от задач зависит.

А так например втыкаешь SSD PCI-E как кеш + диски. И скорость уже сразу очень даже, без лишних вложений.

Ну разумеется, серебрянной пули не бывает.

Особенно в части латенси согласен, при построении катастрофоустойчивых решений.

Но, все таки, наиболее массовое решение с FC СХД устраивает очень многих. А для специфичных задач, и будут применяться нишевые решения.

внедрение и проектирование

Мне тоже нравится это дело. Ибо - интересно до одури. Но, не часто, жаль.

Ну и при объемах в сотни терабайт, цена гигабайта не фига не малнькая.

А для высокой нагрузки по IO надо делать ssd кеш в современных реалиях. В свое время да 10ка было не плохо.

А покупать хороший аппаратный контроллер что бы экономить на паре дисков уже отдает извращением.

Пятерка, имеет свойство рассыпаться под серьезной нагрузкой во время ребилда, особенно на малом количестве дисков. По крайней мере, статистика об этом говорит.

Для пользователя никакие рейды не нужны:

RAID 0 просто не нужен (проще и дешевле медленный SATAшный SSD заменить на PCIный),

RAID 1 неудобен, его хардварной поддержки нет в большинстве устройств, для дома избыточен (можно делать бекапы в облако, потеря информации, не связанной с работой, за пару дней не критична).

Я на числодробилке видел raid0 из ssd с интерфейсом m2. там линейное чтение больших объемов было под 3 гб/сек. запись под 2.

Я думаю упертые геймеры порадуются такой скорости при загрузке игрушек.

Я на числодробилке видел raid0 из ssd с интерфейсом m2. там линейное чтение больших объемов было под 3 гб/сек. запись под 2.

Я специально сделал акцент на том, что говорю про пользовательский компьютер, а не выполняющий какую-либо узкую задачу.

Я думаю упертые геймеры порадуются такой скорости при загрузке игрушек.

Не будет разницы.

У меня у самого 1.8ГБ/с с одного SSD, еще не было ситуации, когда такая скорость была бы узким местом.

Даже бубнта с её тормознутой Unity в качестве de летает на такой конфигурации. Про стабильность это ты конечно знатно шутканул ( https://www.youtube.com/watch?v=tmPG5WfO14A ). А про энергосбережение - из коробки оно похуже, чем в шиндовз. Но блин можно настроить так, что даже мак будет отсасывать по автономности.

Даже бубнта с её тормознутой Unity в качестве de летает на такой конфигурации.

Да, до того момента, пока не запускаешь браузер, толпу месенджеров и т.д.

Про стабильность это ты конечно знатно шутканул

Вовсе нет. Сам использую Linux на работа. т.к. разрабатываю под эту ОС ПО.

Всё то, что касается серверов, крайне стабильно. А попытка сделать систему для пользователей - фейспалмище. Что вполне логично, если брать во внимание финансирование. Будет нормальное финансирование - появится и качество, и стабильность.

Это уже случилось с мобильным Linux - сейчас это самая лучшая и популярная ОС для смартфонов (Android).

Да, до того момента, пока не запускаешь браузер, толпу месенджеров и т.д.

Когда я говорил что летает, я имел ввиду вместе с браузером и толпой меседжеров. У меня сейчас у девушки ноут на атоме с бубнтой и юнити, там медленный винт и есть 4 гига оперативки, хром + лиса в паралели + несколько тяжёлых вещей на electron + по мелочи, всё летает.

Вовсе нет

Аргументированно и по пунктом пожалуйста. Лично я считаю что Linux это единственная стабильная система для декстопа на текущий момент. (мак не в счёт в т.ч. по религиозным мотивам, и вообще все кто им пользуются латентные педики в большинстве случаев)

Я,однажды назвал сумммарные характеристики 4 лезвий для блейд-шасси, человеку, далекому от серверов.

Первый же вопрос был - хорошо ли там летает какая-то топовая на тот момент игрушка.

[На 4 лезвия в сумме было 96 ядер, и 1TB DDR4]

Конкретно эта железка стоила чуть меньше 10 миллионов.

FlexPod Datacenter, если конкретней.

IT-юмор

5.6K постов52.5K подписчиков

Правила сообщества

Не публикуем посты:

1) с большим количеством мата

2) с просьбами о помощи

3) не относящиеся к IT-юмору