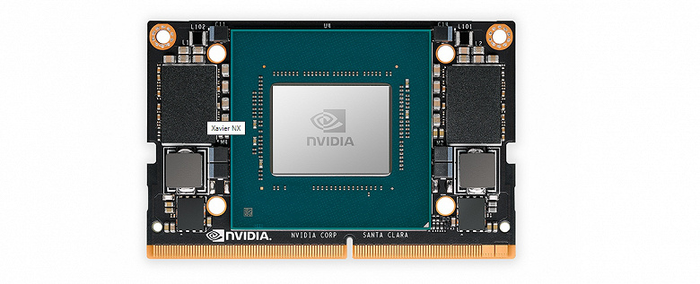

Nvidia представила крошечный одноплатный суперкомпьютер Jetson Xavier NX

Компания Nvidia представила Jetson Xavier NX — самый маленький в мире суперкомпьютер с ИИ для роботов и встраиваемых систем. Как можно видеть на изображениях, размер платы суперкомпьютера действительно небольшой. Если точнее, габариты равны 69,6 х 45 мм.

Конечно, термин суперкомьютер Nvidia в данном случае применяет на свой «страх и риск». На самом деле сердцем Jetson Xavier NX служит однокристальная система с шестью процессорными ядрами Nvidia Carmel и GPU Volta с 384 ядрами CUDA и 48 тензорными ядрами.

Также суперкомпьютер получил 8 ГБ оперативной памяти LPDDR4X и 16 ГБ флэш-памяти eMMC 5.1. Всё это потребляет 10-15 Вт при производительности в 21 TOPS (при 15 Вт; при 10 Вт производительность равна 14 TOPS). Крошечный суперкомпьютер выполнен на плате формата SO-DIMM.

Arduino & Pi

1.5K поста20.9K подписчика

Правила сообщества

В нашем сообществе запрещается:

• Добавлять посты не относящиеся к тематике сообщества, либо не несущие какой-либо полезной нагрузки (флуд)

• Задавать очевидные вопросы в виде постов, не воспользовавшись перед этим поиском

• Выкладывать код прямо в посте - используйте для этого сервисы ideone.com, gist.github.com или схожие ресурсы (pastebin запрещен)

• Рассуждать на темы политики

• Нарушать установленные правила Пикабу