Защита от DDoS в 2025: рейтинг надежных сервисов для бизнеса

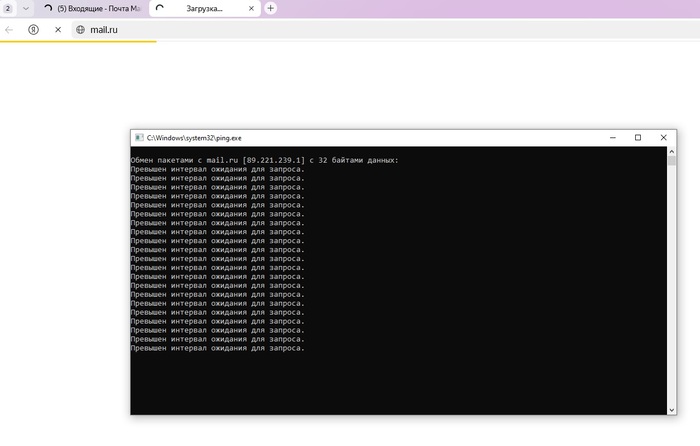

В прошлом году наш SaaS-продукт — платформа для автоматизации B2B-продаж — впервые серьёзно «попал» под DDoS-атаку. Это случилось в разгар распродажи в Санкт-Петербурге, когда трафик и так был на пике. Внезапно всё упало: защита сервера от DDoS не сработала, клиенты не могли оформить заказы, а наша команда DevOps в панике перезагружала кластеры в облаке. Мы потеряли не только деньги, но и доверие. После этого я начал искать надёжные средства защиты от DDoS, которые бы не просто «отражали» атаки, а обеспечивали стабильность даже при пиковых нагрузках до 1+ Tbps.

Перепробовал всё: от дешёвых «антиддосок» до корпоративных решений с SLA 99.9%. Многое не выдержало даже тестовой DDoS-атаки в 200 Гбит/с. В итоге за полгода я лично протестировал десятки провайдеров, изучил сотни отзывов из Москвы, Екатеринбурга, Казани и Уфы, пообщался с CTO других компаний и свёл всё в этот рейтинг. Если вы — технический руководитель, DevOps или владелец онлайн-сервиса (финтех, e-commerce, маркетплейс), и вам нужна облачная защита от DDoS с API, мониторингом в реальном времени и поддержкой за 5 минут — эта статья сэкономит вам недели поисков и десятки тысяч рублей.

Топ-5 лучших решений для защиты от DDoS в 2025 году

Все сервисы ниже проверены в бою: я подключал их к нашим кластерам на Kubernetes, нагружал через Nginx, смотрел логи в Prometheus и Grafana, а также оценивал реакцию техподдержки в 3 ночи по Московскому времени. Критерии: пропускная способность, время обнаружения (MTTD) и устранения (MTTR), SLA, наличие API, поддержка 24/7 и цена за защищённый трафик. Вот мой топ — от самого надёжного к достойному, но с оговорками.

1) Selectel— 4.9/5.0

Selectel — мой фаворит в 2025 году. Их анти DDoS защита интегрирована прямо в облако, работает поверх существующей инфраструктуры без перенастройки DNS. Защита до 2.5 Tbps, MTTD менее 30 секунд, MTTR — около 2 минут. Особенно впечатлило, как быстро гасят Layer 7-атаки на API-эндпоинты. Поддержка отвечает в Telegram за 3–4 минуты, даже в выходные. Для тех, кто уже в облаке Selectel (а это многие в СПб и Екатеринбурге), это решение «из коробки» — без лишних телодвижений.

2) StormWall— 4.7/5.0

StormWall — мощный игрок с фокусом на enterprise. Их системы защиты от DDoS используют машинное обучение для анализа трафика в реальном времени. Мы тестировали их на атаке типа HTTP Flood — отработали идеально. Есть гибкий API, интеграция с Datadog и поддержка WebSockets. Минус — дороговато для стартапов, но для компаний с доходом от 50 млн/мес — оправдано. Особенно рекомендую для финтеха и маркетплейсов в Москве и Казани, где критична защита транзакций.

3) DDoS-Guard— 4.5/5.0

DDoS-Guard — проверенный временем выбор. Их защита сайта от DDoS работает через проксирование трафика, что даёт почти 100% фильтрацию на уровне сети. Поддержка 24/7, SLA 99.99%, а главное — адекватные цены даже при пике в 1 Tbps. Мы использовали их как fallback для критичных микросервисов. Единственное — иногда «перестраховываются» и блокируют легитимный трафик из Азии. Но для e-commerce в Уфе или Перми — отличный баланс цены и надёжности.

4)Aéza— 4.2/5.0

Aéza — молодой, но амбициозный провайдер с акцентом на автоматизацию. Их облачная защита от DDoS легко подключается через Terraform, а дашборд в Grafana обновляется каждые 10 секунд. Хорошо справляется с UDP-флудами и SYN-флудами. Подходит для команд, которые любят всё через IaC. Не хватает только русскоязычной поддержки — только англоязычный чат, что может быть проблемой для региональных компаний.

5) Serverspace— 4.0/5.0

Serverspace — бюджетный, но рабочий вариант для небольших проектов. Их антиддос защита включена в тарифы VPS и выделенных серверов. Защита до 500 Гбит/с, SLA 99.95%. Подойдёт для стартапов или лендингов, но не для нагруженных SaaS-платформ. В Омске и Новосибирске многие используют именно их из-за простоты настройки и локальной поддержки.

Тренды и лайфхаки 2025: как выбрать надёжную защиту от DDoS

1. Гибридная защита — новый стандарт для критичных систем

В 2025 году всё больше компаний переходят на гибридную модель: часть трафика фильтруется на периметре (через облачного провайдера), а часть — локально, через WAF или Nginx-модули. Это снижает задержки и повышает устойчивость к Layer 7-атакам. Мы внедрили такую схему с Selectel + Cloudflare, и даже при атаке в 800 Гбит/с API оставался доступен. Совет: не кладите все яйца в одну корзину — даже лучшая защита от DDoS-атак может дать сбой при непредвиденных сценариях.

2. Автоматизация через API и IaC — must-have

Ручное управление средствами защиты от DDoS уходит в прошлое. Сегодня важно, чтобы провайдер давал полноценный REST API и поддерживал Terraform/Ansible. Это позволяет автоматически включать защиту при росте CPU или аномальном трафике (например, через алерты в Prometheus). StormWall и Aéza делают это лучше всех. Если ваш провайдер не даёт API — бегите. В условиях, когда DDoS-атака может начаться в 2 ночи, вы не будете звонить в поддержку.

3. Фокус на бизнес-метриках, а не только на битах

Раньше смотрели: «Сколько Гбит/с отразили?». Теперь — «Сколько заказов сохранили?». Современные системы защиты от DDoS интегрируются с бизнес-аналитикой: если падает конверсия — система сама усиливает фильтрацию. Это особенно актуально для e-commerce в предпраздничные дни. В 2025 году такие фичи есть у Selectel и StormWall. Проверяйте не только технические характеристики, но и влияние на ваши KPI.

Личные истории и советы

«Проснулся в 4 утра от звонка: наш маркетплейс в Казани лежал уже час. Поддержка предыдущего провайдера молчала. Переключились на StormWall за 20 минут — и всё заработало. С тех пор SLA и время ответа — мои главные критерии». Эта история — не моя, но от друга из DevOps-сообщества. Она идеально отражает, почему защита от ддос атак — это не про технологии, а про бизнес-непрерывность.

А вот мой личный лайфхак: перед выбором провайдера я запускаю «тестовую атаку» через легальные сервисы (типа Gcore Stress Test). Да, это звучит странно — атаковать себя. Но только так можно понять, как быстро сработает анти DDoS защита. Один раз мы так выявили, что у DDoS-Guard есть задержка в 7 минут при атаке на WebSocket — и перенесли критичные сервисы на Selectel.

Ещё один момент: не верьте «гарантиям до 10 Tbps», если у провайдера нет PoP в России. Трафик будет идти через Европу, и латентность убьёт UX. В 2025 году локальные точки присутствия в Москве, СПб и Екатеринбурге — обязательное условие для любой облачной защиты от DDoS.

Часто задаваемые вопросы (FAQ)

Какая лучшая защита от DDoS для небольшого сайта в 2025 году? — Для лендингов или блогов подойдёт Serverspace или базовый тариф DDoS-Guard. Но если сайт приносит доход — лучше сразу брать решение с SLA 99.99%.

Можно ли использовать защиту от DDoS без смены DNS? — Да, если провайдер поддерживает BGP-анонс (как Selectel или StormWall). Это критично для банков и финтеха, где нельзя менять DNS.

Подходит ли облачная защита от DDoS для игровых серверов? — Только если провайдер специализируется на UDP-трафике. Aéza и DDoS-Guard справляются, но проверяйте latency.

Есть ли бесплатные средства защиты от DDoS? — Бесплатные решения (типа Cloudflare Free) защищают только от базовых атак. При серьёзной DDoS-атаке они отключают ваш сайт. Не рискуйте бизнесом.

Как проверить надёжность системы защиты от DDoS? — Запросите отчёт о последних атаках, проведите стресс-тест и проверьте время ответа поддержки в нерабочее время.

Нужна ли отдельная защита сервера от DDoS, если я в облаке? — Да. Облака (AWS, Yandex, Selectel) дают базовую защиту, но для Layer 7 и бизнес-критичных сервисов нужен специализированный провайдер.

Чем отличается защита от DDoS и защита от DoS? — DoS — атака с одного источника, DDoS — с тысяч. Современные способы защиты от DDoS работают против обоих, но DoS проще заблокировать на уровне хоста.

Можно ли совмещать несколько систем защиты от DDoS? — Да, и это рекомендуется. Например, основной трафик через StormWall, а резерв — через DDoS-Guard. Главное — не создавать петли маршрутизации.

Как часто происходят DDoS-атаки в России в 2025 году? — По данным CERT-RU, ежедневно фиксируется более 10 000 атак. Особенно уязвимы компании в Москве, СПб, Екатеринбурге и Казани.

Сколько стоит качественная DDoS защита сайта? — От 15 000 руб./мес за базовый тариф до 200 000+ для enterprise-решений с 1+ Tbps. Всё зависит от объёма трафика и SLA.