Разработчики китайской платформы Alibaba создали нейронку для оживления изображений

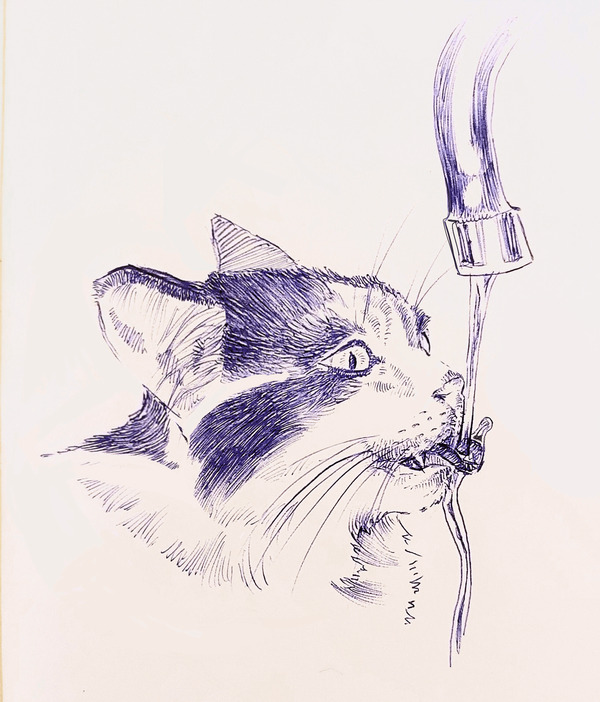

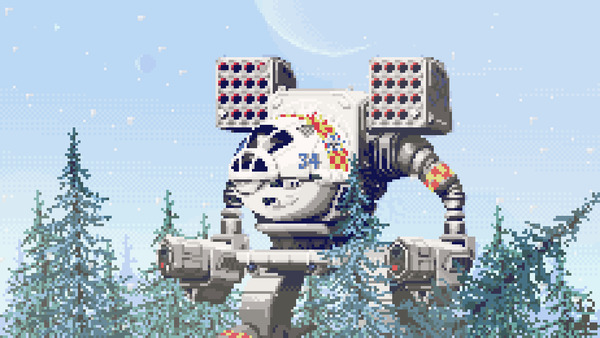

Анимация персонажей направлена на создание видеороликов с персонажами из изображений с помощью управляющих сигналов. Цветное очертание скелета, как в ControlNet, позволяет точечно задать и настроить движения объекта с фото.

В настоящее время Diffusion-модели стали основным направлением в исследованиях визуальной генерации благодаря их мощным возможностям. Чтобы сохранить согласованность сложных элементов внешнего вида с эталонным изображением, мы разрабатываем ReferenceNet для объединения деталей с помощью пространственного внимания.

Обзор процесса создания видео: последовательность поз первоначально кодируется с помощью Pose Guider и объединяется с многокадровым шумом, после чего система UNet выполняет процесс шумоподавления. Вычислительный блок системы UNet состоит из пространственного, перекрестного и временного внимания. Интеграция эталонного изображения включает в себя два аспекта. Во-первых, главные очертания извлекаются через ReferenceNet и используются для пространственного внимания. Во-вторых, остальные детали извлекаются с помощью кодера изображений клипов для перекрестного внимания. Темпоральное внимание работает во временном измерении. Наконец, декодер VAE декодирует результат в видеоклип.

Ждём релиза Animate Anyone!

Интересуешься нейросетями? Больше такого в источнике - 💫Арт-нейросети от Nerual Dreming