В Казани научились эффективнее прогревать нефть в пласте при помощи кислоты

Специалисты Казанского федерального университета усовершенствовали технологию внутрипластового горения. Для этого они использовали олеиновую кислоту.

Внутрипластовое горение — метод нефтедобычи, при котором нефть в пласте разогревают при помощи электронагревателей, газовых горелок или реакций окисления. Нагреваясь, нефть становится менее вязкой, что упрощает процесс ее извлечения.

Как объясняют авторы разработки, олеиновая кислота при нагреве быстрее начинает взаимодействовать с кислородом, содержащемся в воздухе. Начинается реакция окисления, в ходе которой выделяется тепло, запускающее процессы окисления нефти. Если закачать кислоту в пласт с углеводородами, это тепло будет разогревать их.

Как показали эксперименты, добавление всего 1–2% олеиновой кислоты в нефть снижает температуру ее окисления с 244–367 до 233–354 градусов. За счет этого процесс нагрева становится более экономичным, быстрым и простым, так как на него затрачивается меньше внешней энергии.

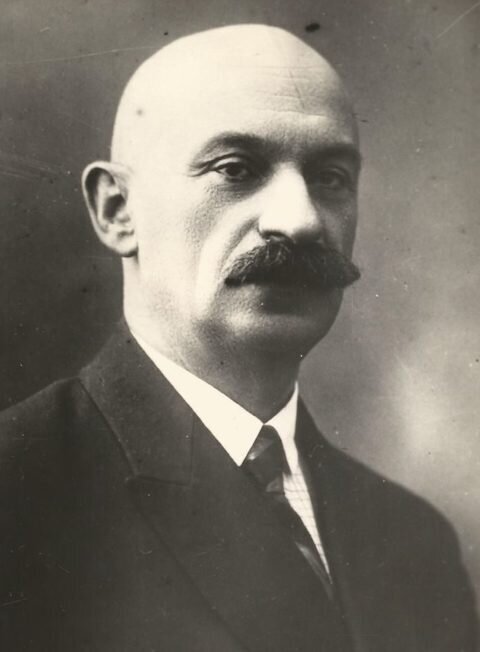

— Михаил Варфоломеев. Руководитель лаборатории методов увеличения нефтеотдачи, заведующий кафедрой разработки и эксплуатации месторождений трудноизвлекаемых углеводородов Казанского федерального университета.

За счет более быстрой инициации окислительных процессов в нефти в итоге образовалось меньше тяжелых компонентов — асфальтенов. Их выход в присутствии олеиновой кислоты снизился с 6,04 до 2,32%. Выход легких компонентов, наоборот, увеличился с 29,64 до 41,05%.

Сейчас научный коллектив работает над созданием комбинированных систем, в которых инициаторы окисления будут закачивать вместе с катализатором, чтобы необходимые реакции в нефти протекали еще быстрее и стабильнее.

Больше новостей об энергетике читайте на сайте журнала Энергия+: https://e-plus.media/news/

Двумерное золото: необычные свойства голдена затмят славу графена

Исследователи из Шведского университета в Линчёпинге разработали новый материал, названный ими "голденом" (goldene). Это двумерная форма золота, представляющая собой лист всего в один атом толщиной. Во многом он аналогичен графену, но первые опыты показывают, что голден обещает быть более интересным.

Переход к двумерной форме открывает новые свойства уже известных материалов. В случае с золотом обнаруживается, что его атомы не используют все связи, доступные им, что делает вещество очень активным во взаимодействии с окружающей средой. Это превращает голден в эффективный катализатор, полупроводник, средство очистки и т.д. Он также может заменить золото в электронных компонентах, что позволит сократить потребление драгоценного металла.

О других свойствах голдена науке ещё предстоит узнать. Однако этот процесс будет сложным, поскольку ученым пришлось преодолеть физические ограничения. Золото ценно тем, что его атомы сильно связаны друг с другом, и двумерная форма золота в природе крайне редка. Поэтому для создания голдена пришлось использовать тонкие кремниевые пластины между титановыми и карбидными тиглями, на которые наносилось золотое покрытие, а затем производилось нагревание до тех пор, пока атомы золота не заменили атомы кремния в поверхностном слое.

Для извлечения голдена из этой конструкции исследователи применили "реактив Мураками". Это вещество, которое использовали древние японские кузнецы для удаления углерода из сплавов. Понадобилось примерно два месяца, прежде чем исследователи увидели блеск первого золота, после чего материал был стабилизирован с использованием ПАВ. Теперь ученые намерены исследовать возможность получения двумерных форм других металлов и их свойства.

Головоломки на Пикабу!

У нас новая игра: нужно расставлять по городу вышки связи так, чтобы у всех жителей был мобильный интернет. И это не так просто, как кажется. Справитесь — награда в профиль ваша. Ну что, попробуете?

Под горой Ачишхо у Красной поляны археологи нашли 2 дольменообразные гробницы

На склоне горы Ачишхо рядом с Красной Поляной были обнаружены две гробницы. Сейчас ими занимается множество исследователей, поскольку подобных находок не было уже 30 лет.

Эксперт Андрей Кизилов отметил, что находки принадлежат эпохе бронзового века. Гробницы похожи внешне, в одной из них было захоронено три человека.

В involta.media добавили, что уже проведена фотограмметрическая съемка камеры гробницы, чтобы построить 3D-модель строения перед предстоящими раскопками.

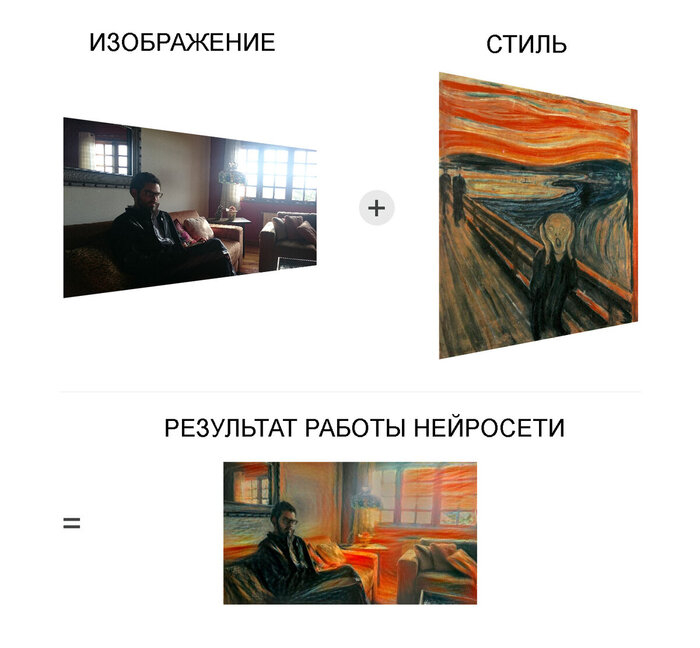

Ответ на пост «Как работает нейросеть? Рассказывает журнал "Лучик"»

Простите поклонники лучика, но не мог пройти мимо. Я не буду разбирать каждый абзац этой статьи и комментировать его, только в конце приведу цитаты и свои комментарии к ним. На мой взгляд статья очень размыто отвечает на главный вопрос, поставленный в заголовке: как работает нейросеть? Я не в курсе на какую возрастную аудиторию рассчитан материал, но с учетом того, что в статье приведена функция y = kx + b, полагаю, я могу использовать немного математики.

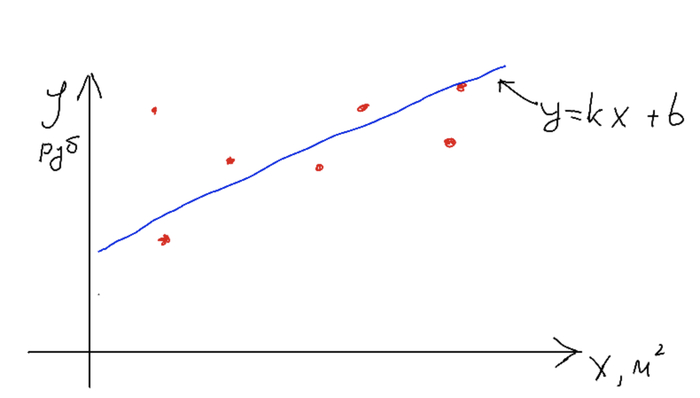

Авторы предлагают аналогию вроде такой: нейросеть - это набор нейронов-чисел, а учатся они, если им показать много примеров. Прежде чем переходить к нейронам, я расскажу как они учатся. Это может показаться странным, но просто принцип обучения что в нейросетях, что в простых моделях машинного обучения одинаков. Для примера рассмотрим как раз уже приведенную функцию y = kx + b. Перенося ее на реальный мир можно взять в качестве примера задачу расчета стоимости жилья в зависимости от площади квартиры. Тогда y - стоимость, x - площадь квартиры, а решаем мы задачу т.н. линейной регрессии (это для сильных духом, постараюсь обходиться без терминов). Далее слайды, которые рисовал сам, простите.

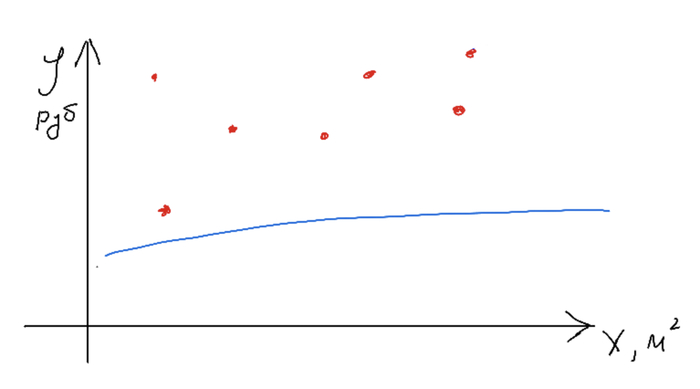

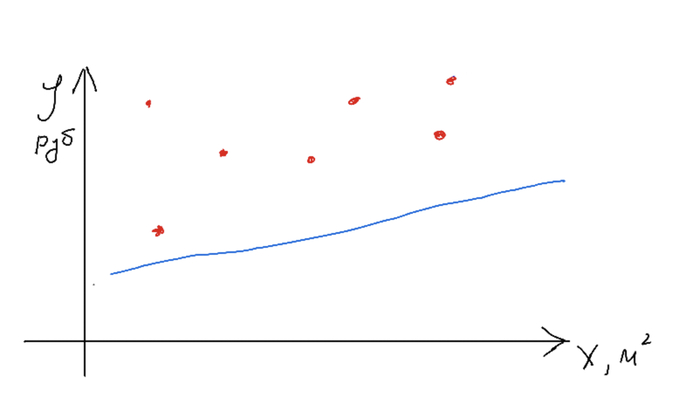

Нужно получить модель, которая по набору иксов (метраж квартиры) дает правдоподобную стоимость. Точки на графике - наши реально существующие данные. Прямая - наша функция. Обучив модель, мы можем подать ей на вход один x и получить ожидаемый y.

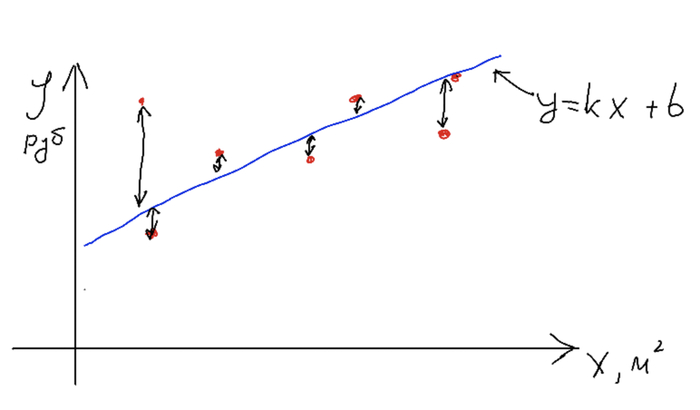

В случае применения машинного обучения мы должны просто настроить неизвестные параметры нашей функции (k и b), чтобы получить оптимальную прямую. Главный вопрос - как? Для этого мы должны ввести понятие ошибки модели, чтобы понять, хороши ли она выполняет свою задачу. В нашем примере ошибка - это разность между предсказаниями и реальной стоимостью.

Ошибка модели - средняя разность между реальными значениями и предсказанными по модулю или в квадрате. Формальным языком: L = (y' - y)^2 / n, где n - количество примеров в данных, y' - предсказания, а y - реальные значения y для наших x).

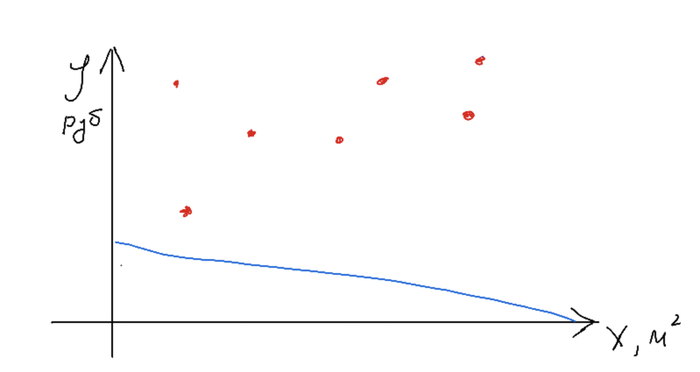

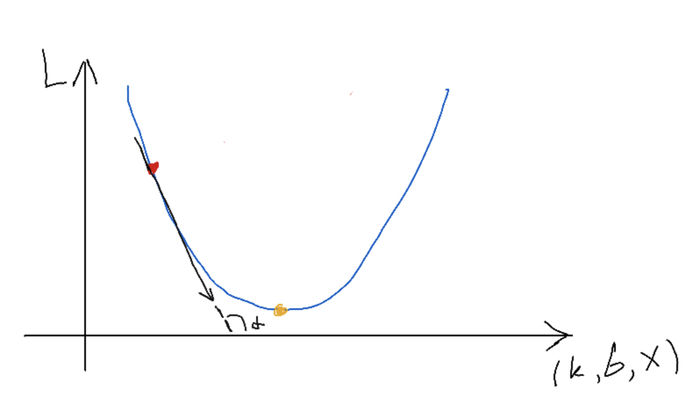

Назовем функцию вычисления ошибок функцией потерь (точнее, она так и называется). Оптимальная модель будет выдавать минимальную среднюю разность, т.е. значение функции потерь будет минимальным. С оценкой определились, теперь переходим к процессу обучения. Для этого мы строим одну случайную прямую, считаем разность между предсказаниями и данными, определяем в какую сторону нам нужно сдвинуть нашу прямую, и сдвигаем, меняя наши k и b на небольшое значение. На какое - задается параметрами модели, обычно этот шаг небольшой, чтобы не перескочить наше оптимальное положение.

Небольшое отступление, которое можно пропустить. Пытливый ум спросит меня, а как мы определяем в какую сторону двигаться на каждом шаге? Отвечаю - просто смотрим на знак. Раньше я упомянул, что для расчета мы используем квадрат или модуль разностей для каждого отдельно взятого примера и усредняем их. Но тогда все наши расчеты будут положительными. Трюк в том, что при обучении мы используем не саму функцию потерь, а производную от нее или т.н. градиент (блин, обещал же без терминов). Геометрически производную можно изобразить так:

Производная - это тангенс угла наклона касательной к функции потерь в выбранной точке. Производная показывает направление роста функции.

На графике изображена функция потерь при разных значениях для нашей задачи - это парабола. Причем левая ветвь соответствует ситуации, когда мы задаем случайную прямую ниже наших точек, правая - выше. Наша задача попасть из красной точки в желтую, т.е. в минимум функции. Определив градиент, мы двигаемся в сторону уменьшения функции, достигая минимума. Математически, при расчете производной (dL = (2 / n) * (y' - y) * x) мы избавляемся от квадрата и можем получать отрицательные значения (и получаем в нашем примере) и тогда двигаемся в противоположную от знака сторону, прибавляя небольшие значения к нашим коэффициентам k и b.

Возвращаясь к объяснению на пальцах. В реальной жизни параметров, влияющих на стоимость квартиры больше, чем просто ее метраж. Тогда мы переходим в многомерное пространство. В реальной жизни у нас есть другие задачи, например то же отделение фотографий кошек от фотографий собак (задача классификации). Или генерация изображений. Но во всех этих задачах используется один и тот же принцип: мы должны определить функцию потерь - определить как мы вычисляем ошибки предсказаний модели и посчитать разницу между предсказаниями и реальными значениями и изменить значения коэффициентов, в зависимости от смещения предсказаний. Для задачи классификации животных (кошек и собак) мы на самом деле строим точно такую же прямую, просто эта прямая не проходит через точки в пространстве, а старается разделить их. Точками в этом случае могут выступать значения пикселей наших картинок, в таком случае, для обычного изображения кошечки, например, разрешением 512х512, мы работаем в 786432-мерном пространстве (потому что 3 (если используем цветное изображение RGB) * 512 * 512 = 786432) и подбираем в этом пространстве не прямую, а плоскость. И уравнение этой плоскости будет таким y = b + k1 * x1 + k2 * x2 + ... + k786432 * x786432. А функция потерь будет другая, но об этом я уже не буду говорить.

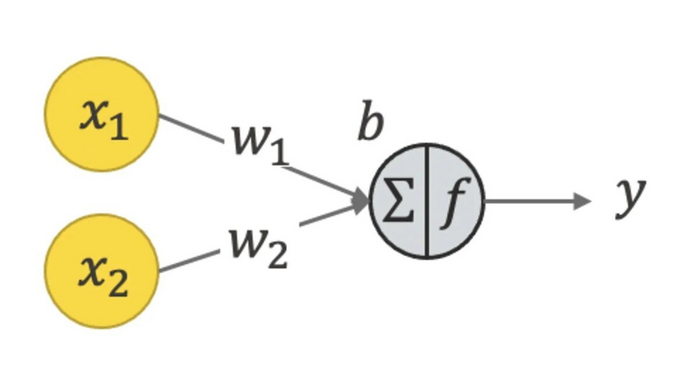

Теперь, когда мы поняли как мы учим, можно понять, что такое нейрон в нейросетях. На самом деле, ответ уже понятен. В процессе обучения мы настраиваем коэффициенты некой функции, нейрон тогда - это просто математическая функция от входных данных. Возвращаясь к статье лучика, на этой картинке нейрон - это как раз таки серый кружочек. А желтые - это значения входных данных. Они могут быть в то же время выходными данными с нейронов предыдущего слоя нейросети.

А сколько нейронов в нейросети? Много и зависит от архитектуры. Входной слой просто принимает данные и вычисляет взвешенную сумму, передавая результат на внутренние слои. На примере тех же изображений - количество нейронов на первом слое будет зависеть от параметров изображения, а именно от количества пикселей, но количество нейронов скрытых (внутренних) слоев мы устанавливаем сами. Мы можем поставить один нейрон на первый скрытый слой, который будет суммировать все данные, но толку от такой сети будет мало. На выходном слое количество нейронов зависит от нашей задачи. Для генерации нам нужно в каждом пикселе сетки предсказать реальное значение цвета, значит нейронов будет столько же, сколько пикселей нам надо получить. Если мы говорим о задаче классификации, то на выходном слое будет столько нейронов, сколько у нас классов - т.е. 2 для кошек/собак, например. Рассматривать необычные слои, вроде сверток, не будем, но они есть.

А зачем вообще нужны нейросети? Я уже выше описал, что все задачи так или иначе формализуются в набор известных функций. Но преимущество нейросетей в том, что они универсальны как раз за счет общих принципов построения. А взаимодействие нейронов на разных слоях позволяет расширить пространство настраиваемых параметров, что в свою очередь позволяет уловить связи в данных на разных уровнях. Например, разные слои нейросети, обученной на задаче классификации изображений, могут улавливать разные паттерны: например контуры, формы или цвета. Что как раз-таки используется для передачи стиля - мы замораживаем глубинные веса обученной нейросети (те, которые отвечают за пространство, форму и т.д.) и дообучаем на одном стилевом изображении только те слои, которые отвечают за "мазки кисти" и цвета.

Несколько примеров современных нейросетей и как они обучены:

Генерация изображений. Существует множество архитектур сетей для генерации. Причем я говорю о генерации без текстового описания. Например, т.н. GAN-ы. Они обучены генерировать изображения из шума, как и сказано в статье. Но они не обучаются специально запоминать формы, объемы, углы, цвета. Они обучаются генерировать изображение так, чтобы результат не отличался от данных, с которыми мы его сравниваем.

Векторизация текстов - я выделил этот пункт отдельно, т.к. все сети, работающие с текстами, должны уметь переходить от тестов к точкам в пространстве - векторам чисел. Описывать, как это происходит примерно так же долго, как я описывал линейную регрессию. Но для простоты скажем, что нейросети учатся предсказывать пропущенные в тексте слова, настраивая при этом числа в пространстве векторов, где каждый вектор соответствует отдельному слову. Это классическая задача классификации, а значит мы снова строим разделяющие плоскости.

Генерация текстов. И снова множество архитектур. Есть даже не нейросетевые (смотрите цепи Маркова, которые просто считают попарные вероятности слов в тексте). Нейросетевые пытаются предсказать одно следующее слово на основе предыдущих.

Генерация изображений по тексту. Здесь мы объединяем известные подходы и идея такая: раз мы уже знаем, как векторизовать текст, то будем использовать вектора текста как входные данные, а готовые изображения, как идеал, который нужно научится генерировать из шума. Для обучения таких моделей используется огромное количество картинок с описаниями к ним. Кстати, поэтому было много претензий к русскоязычным генеративным моделям, которые генерировали, например, американские флаги по запросу "Родина". Просто сложно создать большой датасет размеченных изображений своими силами, все используют открытые датасеты, и, например, переводят тексты и всячески обогащают данные.

Теперь можно перейти к самому интересному - цитаты из статьи.

Компьютерный нейрон – это просто... число!

Уже выяснили, что нет.

«А если собаки и кошки раскиданы вперемешку, а?» – спросите вы. Ну что ж, тогда нам может потребоваться не одна линия. И возможно не две и не три, а целый десяток или даже сотня. Важно понять, что рано или поздно мы сможем с помощью обыкновенных чисел и прямых «поделить» наш лист так, чтобы нейросеть уже знала наверняка – что именно она «видит», кошку или собаку, в чью именно область она «ткнула пальцем».

Я зацепился за это определение. Потому что если нам известно только 2 класса, то будет только одна "линия" на выходе. Да, каждый нейрон строит свое собственное решение, но он во-первых, не видит какую-то свою область данных, а во-вторых, его решение агрегируется с решениями всех остальных нейронов на выходном слое. То, что описано - это скорее работа классических деревьев решений, которые действительно нарезают пространство на сколько угодно областей.

Проблема номер один – для обучения нейросети нужно очень много информации. Чтобы научить нейросеть отличать кошку от собаки, ей нужно показать тысячи (лучше миллионы) самых разных кошек и собак. Воспитанник детского садика в возрасте трёх лет кошку с собакой не спутает, даже если видел их всего лишь пару раз в жизни...

С миллионом явный перебор. Кроме того, существуют техники дообучения, позволяющие переиспользовать обученные модели с гораздо меньшим набором данных.

Проблема номер два: нейросети совершенно не умеют анализировать собственные творения, объяснять, «что здесь нарисовано и почему», в частности, они не умеют считать! Из-за этого компьютерные изображения постоянно рисуют людей то с шестью, то с восемью пальцами. Или кошек то с тремя, то с пятью лапами.

Вообще-то, объяснять уже умеют. Но только узкий класс мультимодальных сетей (если мы обучим модель генерировать текст по изображению - обратная задача генерации изображения по тексту - то сможет). А с пальцами проблема в общем тоже пофикшена улучшениями архитектур и увеличением количества параметров моделей. Были бы деньги обучать такие модели.

Проблема номер четыре: нейросеть не умеет работать при нехватке информации, «достраивать недостающее». Скажем, человеческий детёныш, даже малыш, увидев кошачий хвост, торчащий из-под дивана, тут же уверенно «распознает» спрятавшегося котёнка и побежит ловить его! Нейросеть такое «неполное» изображение понять не в состоянии. Человек, исказивший внешность (скажем, надевший маску или загримированный) для современной нейросети опять же становится неузнаваемым.

Умеет и достраивает. И распознает и людей в масках узнает. Опять же, на это влияют как архитектура, так и способ получения данных. Всегда можно аугментировать изображения (например в части тренировочных изображений кошек и собак обрезать все, кроме хвостов и тогда такая нейросеть сможет по хвосту определить животное).

Проблема номер пять: нейросеть совершенно не понимает законов нашего мира – скажем, тех же законов оптики. Она никогда не сможет различить на картине человека – и его отражение в зеркале (для живого человека – задачка пустяковая). Она никогда не сможет различить человека или его лицо в кривом зеркале (как это делаем мы на аттракционе «Комната смеха» в городском парке, или когда разглядываем самих себя в новогодние шарики).

Аналогично - аугментация данных решает проблемы с кривыми зеркалами.

Проблема номер шесть: нейросети чрезвычайно чувствительны к разного рода помехам, дефектам, «шуму». Скажем, если на старой фотографии часть изображения залита грязью, чернилами, испорчена пятнами или царапинами, сильно выцвела, если карточка разорвана или разрезана напополам – уверенное узнавание тут же становится неуверенным и вообще ошибочным. Для человека сломанная на части кукла – всё равно кукла; для нейросети – это уже совершенно другой, неизвестный объект

Формально - да. Именно поэтому при обучении специально добавляют шум, аугментируют данные, выключают часть нейронов. И тогда модель справляется.

Проблема номер семь: нейросети на текущий момент ужасающе «однопрограммны». Если нейросеть настроена на распознавание лиц – она будет уметь только распознавать лица. Переучить её на написание текстов или музыки будет чрезвычайно сложно, часто вообще проще написать и обучить совершенно новую сеть. Если она умеет отличать квадраты от треугольников – даже не пробуйте попросить её отличить кошку от собаки или самолёт от парусной лодки...

В целом верно, но не совсем. В рамках одной моды и архитектуры - работа с текстом, или изображениями, или музыкой - переучить нейросеть не проблема. И даже мультимодальные модели существуют и активно развиваются. Но да, архитектура генератора музыки и генератора изображений и данные для этих сетей настолько разные, что просто в тупую подменить данные нельзя. Удивительно.

Проблема номер восемь: связи между компьютерными нейронами случайны, поэтому нейросети лишены запоминания созданных образов. На приказ «нарисуй мне дерево» нейросеть охотно откликнется и будет рисовать деревья снова и снова, но... каждый раз это будет «другое дерево». И если вы напишете команду «нарисуй мне такое же дерево, как в прошлый раз, только на берегу реки», нейронная сеть не поймёт вас. Она опять нарисует «новое случайное дерево».

Связывать случайность (кстати, они не случайны, а заданы архитектурой) связей между нейронами и неспособность запоминать созданный образ - максимально некорректно. То, что здесь описано, на самом деле решаемо. Но это решение за пределами архитектуры нейросети. Это как предъявлять претензии микроволновке, за то, что она не включила сама кнопку, типа, могла бы и запомнить. У нее нет инструментов запоминания результата, как нет у голой нейросети - она получает данные на вход, генерирует выход и все.

В целом, я догадываюсь, что изначальная статья была рассчитана на детей младшего школьного возраста. И я по размышлению выкинул из моего разбора несколько цитат, которые на самом деле оказались верны, просто сильно упрощают представление. И то, что я описал может быть не всем понятно и требует более глубокого погружения.

Резидент "Сколково" Spawn перерабатывает мусор при помощи грибницы и создает мебель

Резидент "Сколково" Spawn придумал способ создавать мебель, перерабатывая мусор. Для этого используются грибницы.

Для инновационного способа переработки мусора учеными-микологами было выведено более 250 штаммов грибов. Грибницы перерабатывают отходы и выдают изделия, которым можно придать любую форму.

В involta.media добавили, что сейчас стартап перерабатывает целлюлозосоджержащие композиты.

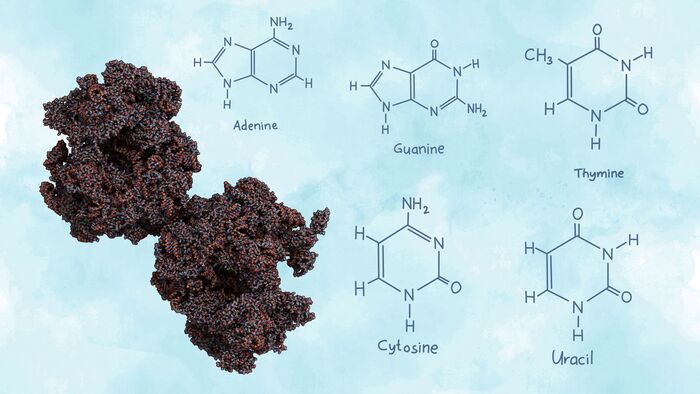

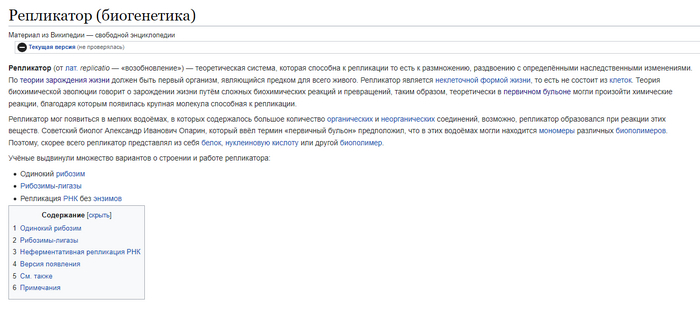

Первая «живая» молекула

Продолжаем пост про возникновение жизни и отвечаем на следующий вопрос.

Как произошёл переход от химических молекул к первым живым организмам?

Этот процесс до сих пор остается загадкой, но благодаря последним достижениям в области молекулярной биологии, ученым все-таки удалось обнаружить потенциального кандидата на роль прародителя всей жизни на нашей планете.

Его назвали репликатором.

Репликатор - это сложная молекула, возникшая в результате химической эволюции. Его главная особенность состоит в том, что он может создавать собственные копии используя другие молекулы, находящиеся поблизости.

Предположительно, репликатор мог быть рибозимом, то есть молекулой РНК, которая осуществляла репликацию других цепочек РНК.

Однако порой в процессе самокопирования возникали ошибки, из-за которых молекулы приобретали новые физико-химические свойства, усложнялись и «обрастали» полезными для выживания структурами, например, мембранами и биополимерами, пока наконец не преобразовались в первую живую клетку.

Вполне возможно, что процесс химической эволюции происходит сразу у нескольких групп молекул, которые затем объединил в единую живую структуру (прообраз современной клетки).

Репликатор будет обладать мутационной изменчивостью. Точечные мутации будут изменять последовательность нуклеотидов, а его последующие репликации будут сохранять эту последовательность. Таким образом, получается репликатор, который действительно реплицируется и сохраняет наследственные изменения.

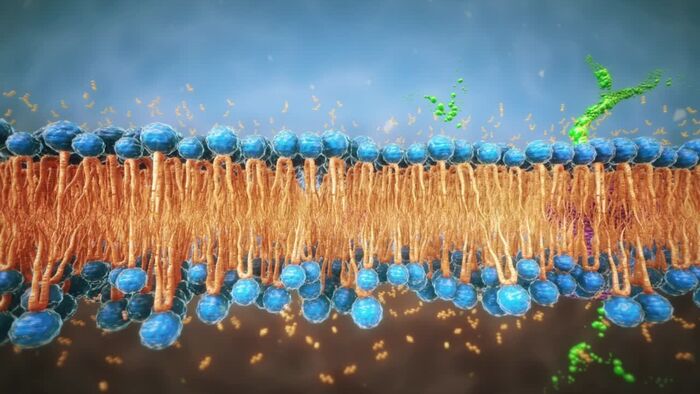

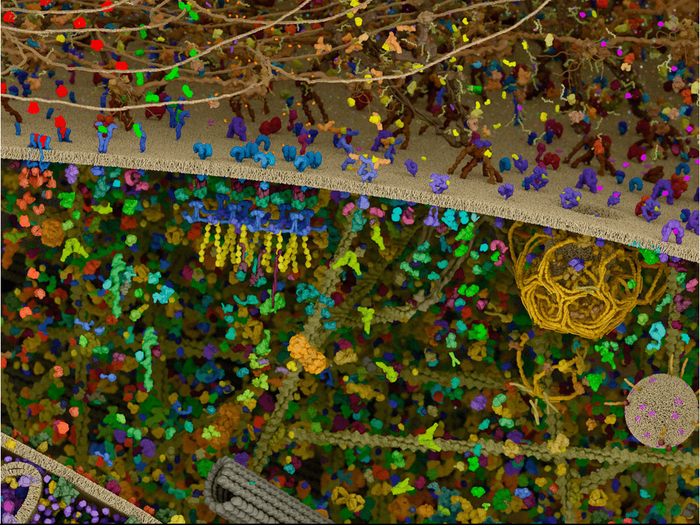

3D-модель мембраны клетки, состоящей из множества молекул фосфолипидов и закреплённых в них белковых структур.

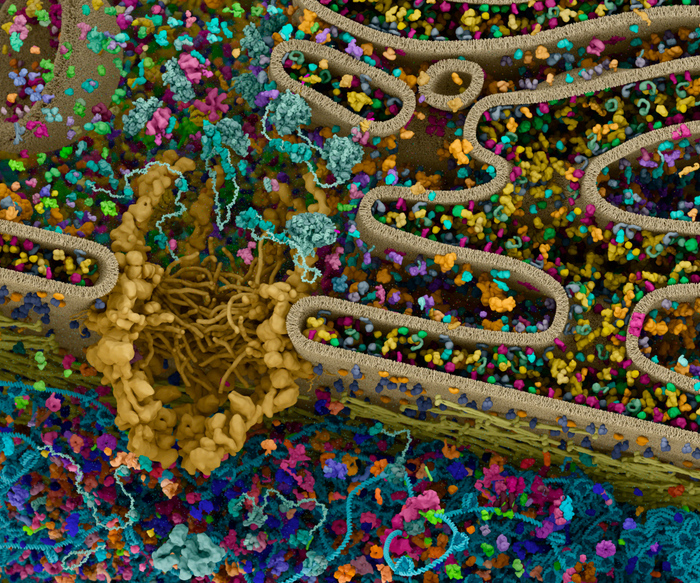

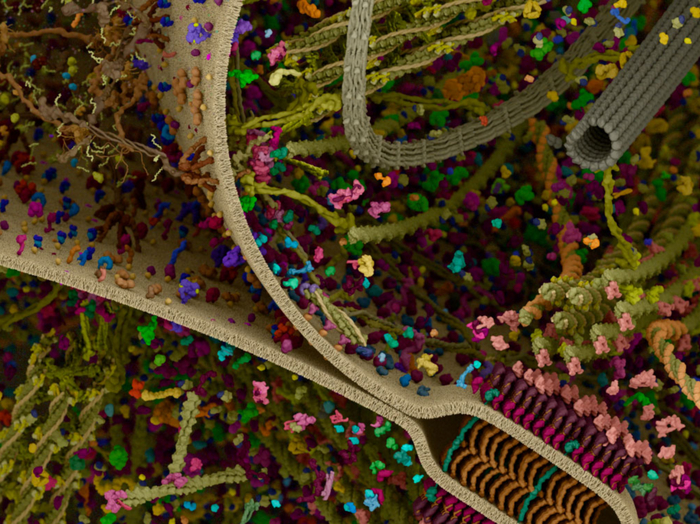

Несколько 3D-моделей, в наибольшей степени демонстрирующих внутреннее устройство живой клетки.

3D-модель устройства живой клетки. Разными цветами обозначены белковые структуры и молекулы липидов, образующие клеточные мембраны.

Общий план строения животной клетки.

Видеоверсия:

Спасибо друзья, больше материалов про биологию и микромир Вы можете найти в моём профиле. Подписывайтесь на канал и до скорых встреч.

Жизнь без тела. (Чем закончилась история с пересадкой головы российского программиста)

Предупреждаем сразу – эта статья не для детей. Более того, она и не для слабонервных взрослых. В особенности – не для любителей животных. А поскольку получается, что читать её нельзя никому, сразу даём ответ на вопрос заголовка: «Ничем». Для любопытствующих история с пересадкой тела Валерию Спиридонову закончилась «ничем», но для него самого довольно неплохо. (Он даже связывался с нами после первой публикации этой статьи и предлагал рассказать подробнее о его новой жизни, но прямо в эти дни началась Специальная военная операция, и стало «не до этого».) Итак...

Найду ли краски и слова?

Пред ним – живая голова...

А.С. Пушкин, «Руслан и Людмила»

Роман писателя-фантаста Александра Беляева «Голова профессора Доуэля» – наверное, самый первый в российской литературе фантастический «роман ужасов». Автору текста эта книга впервые попала в руки, когда ему было 11 лет – и сразу же произвела неизгладимое впечатление. Хладнокровный и подлый профессор Керн, добрая и отзывчивая Мари, наконец, полная страданий истинно трагическая судьба профессора Доуэля, выдающегося врача...

Сам Беляев неоднократно утверждал, что на идею создания подобного романа его натолкнула собственная тяжёлая болезнь – туберкулёз позвоночника. Несколько долгих лет писателю пришлось провести лёжа в кровати, в гипсовом корсете. Впрочем, руки у него всё-таки могли двигаться, так что ему было всё-таки намного легче, чем описанному в книге герою...

Однако у многих исследователей есть веские основания считать, что на самом деле идея рассказа о «голове без туловища» пришла не только на основе собственных больничных переживаний. Дело в том, что как раз в то время (а первая редакция книги увидела свет в 1925 году) тема «головы без тела» и вообще хирургической пересадки разных органов была очень популярной. Скажем, в том же 1925 году другой писатель, Михаил Булгаков, практически одновременно с Беляевым пишет повесть «Собачье сердце». Чистое совпадение? Вряд ли.

За годы Первой мировой войны (1914 – 1918) медицина, а особенно хирургия, добилась огромных, без преувеличения, успехов. Огромное количество раненых, миллионы хирургических операций позволили медикам накопить колоссальный опыт и научиться бороться с самыми тяжёлыми ранениями. Если в начале войны серьёзное попадание разрывной пули или осколка снаряда в руку или ногу чаще всего заканчивалось ампутацией, то ближе к концу врачи поняли, что даже наполовину оторванную конечность – при условии максимально быстрой госпитализации! – можно спасти. Американский доктор Мэри Кроуфорд позже напишет в своём дневнике: «От войны медицина выигрывает более всех остальных. Это ужасно, но это так».

Известия об успехах военных хирургов и о проведённых врачами чудо-операциях не сходили со страниц газет. Простым людям начало казаться, что медицина скоро станет всесильной.

В 1920 году профессор медицины Николай Богораз, к тому времени уже известнейший специалист, попал под трамвай, ему отрезало обе ноги. Он продолжил работать – на протезах! – и все свои дальнейшие исследования посвятил вопросам пересадки конечностей. (Его судьбе посвящён художественный фильм «И снова утро».)

Ученики Богораза добились серьёзных успехов – например, во время опытов они отрезали лабораторной собаке ногу, а затем пришивали её на место, причём нога успешно срасталась, заживала и функционировала. «Но если так можно поступить с ногой,» – рассуждали многие – «то разве нельзя проделать то же самое с головой? С мозгом? То есть спасти от неизбежной смерти разум, сознание человека?».

На самом деле мы даже сейчас, в XXI веке, ещё очень плохо понимаем – и что такое разум, и что такое сознание. Однако 100 лет назад энтузиастам дело казалось проще пареной репы. «Желудок выделяет желудочный сок, поджелудочная железа – гормон инсулин, а мозг точно так же выделяет мысли!» – с жаром спорили они. Нужно просто «всего-навсего» быстро соединить идущие к мозгу нервные окончания и кровеносные сосуды, после чего мозг будет жить и функционировать отдельно от тела.

Дошло до того, что в 1924 году в Советской России после смерти мозг В.И. Ленина сохранили и начали изучать в специально созданном «Институте мозга». Некоторые и вовсе предлагали подвергнуть тело Ленина глубокой заморозке, чтобы потом, как только медицина достигнет нужного уровня, «разморозить» и вернуть к жизни...

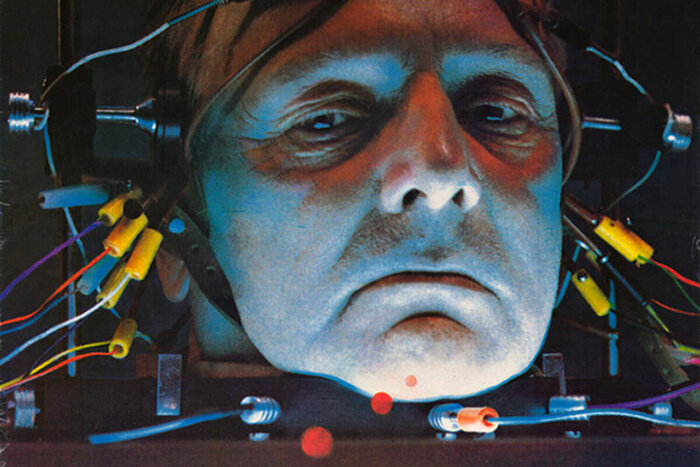

В 1925 году талантливый врач-экспериментатор (и изобретатель) Сергей Брюхоненко продемонстрировал созданный им (впервые в мире!) автожектор, то есть аппарат искусственного кровообращения («сердце-лёгкие»). И уже скоро с гордостью демонстрировал многочисленным коллегам, как «живёт», двигает глазами и шевелит языком собачья голова, отрезанная от туловища. Правда, «жить» голове удавалось всего лишь несколько часов – однако многие были убеждены, что всё это чисто «временные затруднения».

Позже, в 1940 году, Брюхоненко снял фильм «Эксперименты по оживлению организма», в котором показал эти жутковатые опыты. (Чувствительным людям лучше не смотреть.)

Так что и «Собачье сердце» Булгакова, и «Голова профессора Доуэля» Беляева написаны на самую актуальную в тот момент научную тему. Причём в 1930 году Беляев снова вернётся к теме «жизни мозга отдельно от тела» – в фантастической повести «Хойти-Тойти». Позже, в 1970 году, американский нейрохирург Роберт Уайт сумеет пересадить голову от одной обезьяны другой – правда, обезьяна снова проживёт после операции меньше часа...

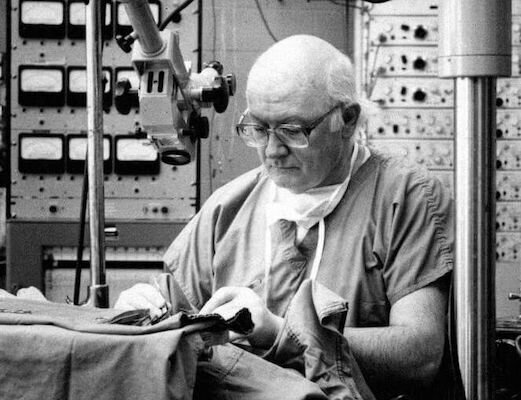

Как к этим гениальным (и одновременно жестоким и чудовищным) опытам относились и относятся люди? По-разному. Скажем, Николай Амосов, выдающийся хирург, писал:

«Как я отношусь к идее жизни изолированной от тела головы? Не вижу в этом никакого кощунства – если бы предложили мне, то согласился бы».

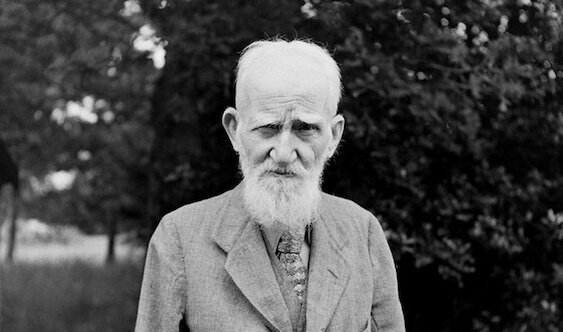

А английский писатель Бернард Шоу, прочитав об опытах Брюхоненко, сказал следующее:

«Меня так и подмывает дать отрезать голову себе, чтобы я мог диктовать пьесы и книги, не беспокоясь о болезнях, о необходимости раздеваться и одеваться, принимать пищу – в общем, обо всём, что только отвлекает от создания хороших литературных произведений!».

А в США появились особые фирмы, которые – за большие деньги! – предлагали (и предлагают) умирающим толстосумам хранить их отрезанные головы в специальных холодильниках. Чтобы, когда медицина научится «воскрешать мозг» и пересаживать его в «новое тело», этих своих клиентов «оживить». Один из особо ретивых энтузиастов высказался так: «Если я смогу прожить ещё лет 200, то согласен даже на тело из пластмассы и силикона».

Однако ещё в том самом романе, написанном в 1925 году, почти 100 лет назад, Александр Беляев мудро предвидит многочисленные «подводные камни» пересадки мозга, прежде всего нравственного, духовного, этического характера. На какие гнусные преступления может толкнуть человека такая возможность? А кто же станет «донорами тел» для избранных «отрезанных голов»? И вообще – окажется ли способным мозг, отделённый от остального организма, по-настоящему мыслить, чувствовать, переживать, творить? Или человек превратится в «овощ», способный только на самые примитивные рефлексы?

Академик Владимир Кованов, выдающийся хирург, писал об этом так:

«Мы можем допустить наличие элементарных форм жизнедеятельности в существующем отдельно от человека мозге, но возможность сознания, мышления для него совершенно исключены. И положение не изменится даже тогда, когда станет возможным искусственный приток информации к такому мозгу. Если исходить из экспериментов на животных, в частности, из факта жизни – и то очень короткое время! – в искусственных условиях головы собаки, можно допустить возможность элементарной мыслительной деятельности. Однако допустимо ли подобное применение к человеку? Мне кажется, ни в коей мере».

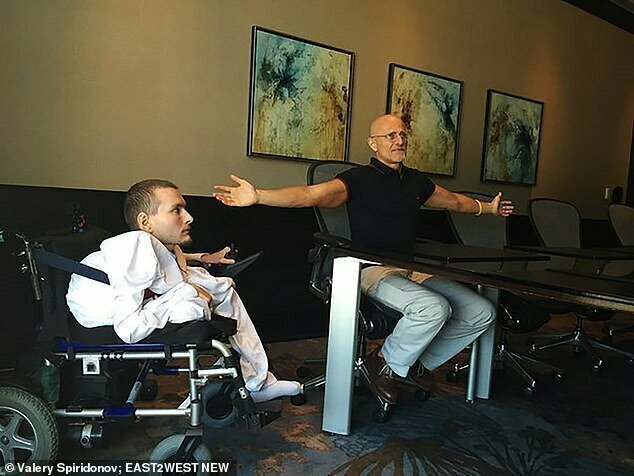

Многие наверняка помнят эту новость: в 2015 году россиянин Валерий Спиридонов, страдающий спинально-мышечной атрофией, вылетел в США по приглашению хирурга Серджио Канаверо, пообещавшего пересадить ему... здоровое тело.

Шуму в СМИ было много, однако чем закончилась эта история? Ничем. Операция не состоялась (якобы не удалось собрать достаточно средств), Канаверо уехал работать в Китай, а Валерий Спиридонов живёт в США. Вот это бассейн во дворе дома, в котором он живёт с женой и ребёнком (кто на фото, не спрашивайте, не интересовались, но фото со страницы его жены):

От природы человеку свойственно любопытство – и невероятно жгуче мучают его «вечные вопросы»: что такое жизнь? Что такое смерть? Что такое разум? Что будет «там», за невидимой ни для кого гранью? И каким будет это «там»?

К сожалению, в истории люди уже не раз сталкивались с тем, что наука и её успехи – несмотря на все изначально благие намерения! – вдруг начинают служить злу, пробуждают в человеке самые низменные страсти.

Сколько жизней спасла операция по пересадке почки? Много. А сколько жизней она искалечила и погубила? Не поленитесь – просто посмотрите, какой популярностью пользуется в поисковиках незатейливый, казалось бы, запрос «сколько стоит в России продать почку в 2022 году»...

Медицина – как любая другая наука! – может одинаково хорошо служить как добру, так и злу. И недаром в романе Беляева изначально благородный замысел профессора Доуэля, попав в руки подлеца и карьериста Керна, приводит к трагедии... Подумайте об этом.

Наш Телеграм-канал: https://t.me/luchik_magazine